+

+

+

+

+

+

+

+

+

+

+

+

+

diff --git a/docs/.vuepress/components/unlock/UnlockContent.vue b/docs/.vuepress/components/unlock/UnlockContent.vue

new file mode 100644

index 00000000000..f85351ae8f4

--- /dev/null

+++ b/docs/.vuepress/components/unlock/UnlockContent.vue

@@ -0,0 +1,243 @@

+

+

+

+

+

+

+

+

+

+

+

+

+

+

+ 人机验证

+ ++ 为保障正常阅读体验,本站部分内容已开启一次性验证。验证后全站解锁。 +

+ +

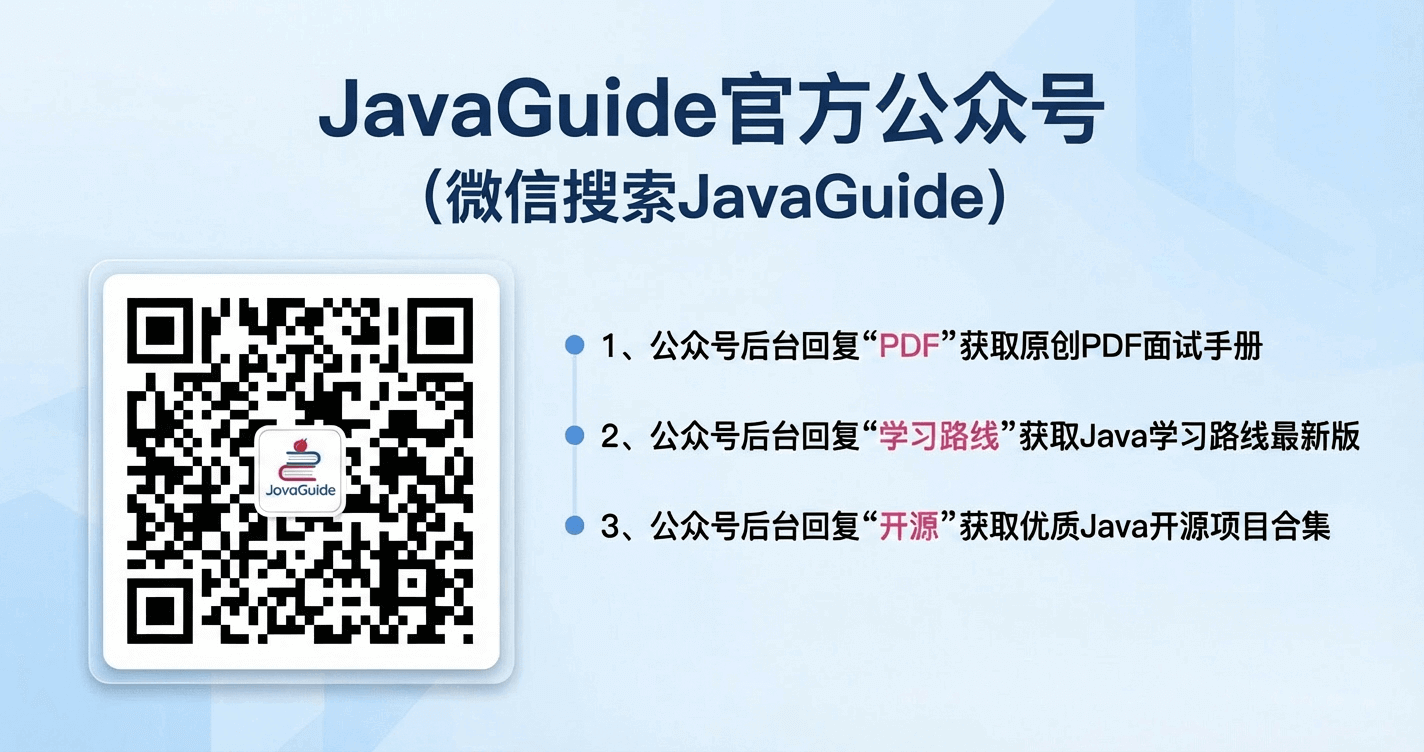

+ ![公众号二维码]() +

+

+

+ + 扫码/微信搜索关注 + “JavaGuide” +

+回复 “验证码”

+

+

+

+

+

+ 验证码错误,请重试

+

+

+

+

+

+

+

+

+

diff --git a/docs/.vuepress/config.ts b/docs/.vuepress/config.ts

index eed17cf0e1d..b34f2b96aa5 100644

--- a/docs/.vuepress/config.ts

+++ b/docs/.vuepress/config.ts

@@ -7,54 +7,60 @@ export default defineUserConfig({

title: "JavaGuide",

description:

- "「Java 学习指北 + Java 面试指南」一份涵盖大部分 Java 程序员所需要掌握的核心知识。准备 Java 面试,复习 Java 知识点,首选 JavaGuide! ",

+ "JavaGuide 是一份面向后端开发/后端面试的学习与复习指南,覆盖 Java、数据库/MySQL、Redis、分布式、高并发、高可用、系统设计等核心知识。",

lang: "zh-CN",

head: [

// meta

["meta", { name: "robots", content: "all" }],

["meta", { name: "author", content: "Guide" }],

- [

- "meta",

- {

- "http-equiv": "Cache-Control",

- content: "no-cache, no-store, must-revalidate",

- },

- ],

- ["meta", { "http-equiv": "Pragma", content: "no-cache" }],

- ["meta", { "http-equiv": "Expires", content: "0" }],

- [

- "meta",

- {

- name: "keywords",

- content:

- "Java基础, 多线程, JVM, 虚拟机, 数据库, MySQL, Spring, Redis, MyBatis, 系统设计, 分布式, RPC, 高可用, 高并发",

- },

- ],

- [

- "meta",

- {

- name: "description",

- content:

- "「Java学习 + 面试指南」一份涵盖大部分 Java 程序员所需要掌握的核心知识。准备 Java 面试,首选 JavaGuide!",

- },

- ],

+ // [

+ // "meta",

+ // {

+ // name: "keywords",

+ // content:

+ // "JavaGuide, 后端面试, 后端开发, Java面试, Java基础, 并发编程, JVM, 数据库, MySQL, Redis, Spring, 分布式, 高并发, 高性能, 高可用, 系统设计, 消息队列, 缓存, 计算机网络, Linux",

+ // },

+ // ],

+ // [

+ // "meta",

+ // {

+ // name: "description",

+ // content:

+ // "JavaGuide 是一份面向后端开发/后端面试的学习与复习指南,覆盖 Java、数据库/MySQL、Redis、分布式、高并发、高可用、系统设计等核心知识。",

+ // },

+ // ],

+ ["meta", { property: "og:site_name", content: "JavaGuide" }],

+ ["meta", { property: "og:type", content: "website" }],

+ ["meta", { property: "og:locale", content: "zh_CN" }],

+ ["meta", { property: "og:url", content: "https://javaguide.cn/" }],

["meta", { name: "apple-mobile-web-app-capable", content: "yes" }],

- // 添加百度统计

+ // 添加百度统计 - 异步加载避免阻塞渲染

[

"script",

- {},

+ { defer: true },

`var _hmt = _hmt || [];

(function() {

var hm = document.createElement("script");

hm.src = "https://hm.baidu.com/hm.js?5dd2e8c97962d57b7b8fea1737c01743";

+ hm.async = true;

var s = document.getElementsByTagName("script")[0];

s.parentNode.insertBefore(hm, s);

})();`,

],

],

- bundler: viteBundler(),

+ bundler: viteBundler({

+ viteOptions: {

+ css: {

+ preprocessorOptions: {

+ scss: {

+ silenceDeprecations: ["if-function"],

+ },

+ },

+ },

+ },

+ }),

theme,

diff --git a/docs/.vuepress/features/unlock/config.ts b/docs/.vuepress/features/unlock/config.ts

new file mode 100644

index 00000000000..c2272adb650

--- /dev/null

+++ b/docs/.vuepress/features/unlock/config.ts

@@ -0,0 +1,37 @@

+import { PREVIEW_HEIGHT } from "./heights";

+

+const withDefaultHeight = (

+ paths: readonly string[],

+ height: string = PREVIEW_HEIGHT.XL,

+): Record

+

+

+

+

+

+

+

+

+

+

+

+

+ 人机验证

++ 为保障正常阅读体验,本站部分内容已开启一次性验证。验证后全站自动解锁。 +

+ +

+ ![公众号二维码]() +

+

+

+ + 扫码关注公众号,回复 “验证码” +

+

+

+

+

+

+ 验证码错误,请重新输入

+ -如果你**时间比较充裕**,更推荐直接在 [JavaGuide 官网](https://javaguide.cn/) 上**系统学习**:内容比突击版更全面、更深入,更适合打基础和长期提升。

+## 🌐 关于网站

-**突击版本网站入口**:[interview.javaguide.cn](https://interview.javaguide.cn/)

+JavaGuide 已经持续维护 6 年多了,累计提交 **6000+** commit ,共有 **620+** 多位贡献者共同参与维护和完善。

-对应的 PDF 版本,可以直接在公众号后台回复“**PDF**”获取:

+网站内容覆盖:

-

-如果你**时间比较充裕**,更推荐直接在 [JavaGuide 官网](https://javaguide.cn/) 上**系统学习**:内容比突击版更全面、更深入,更适合打基础和长期提升。

+## 🌐 关于网站

-**突击版本网站入口**:[interview.javaguide.cn](https://interview.javaguide.cn/)

+JavaGuide 已经持续维护 6 年多了,累计提交 **6000+** commit ,共有 **620+** 多位贡献者共同参与维护和完善。

-对应的 PDF 版本,可以直接在公众号后台回复“**PDF**”获取:

+网站内容覆盖:

- +- **后端面试**:Java 基础、集合、并发、JVM、MySQL、Redis、分布式、系统设计等核心知识。

+- **AI 应用开发**:大模型(LLM)基础、Agent 智能体、RAG 检索增强生成、MCP 协议等前沿技术。

-## 面试辅导

+真心希望能够把这个项目做好,真正能够帮助到有需要的朋友!

-给自己打个小广告,如果需要面试辅导(比如简历优化、一对一提问、高频考点突击资料等),欢迎了解我的[知识星球](https://javaguide.cn/about-the-author/zhishixingqiu-two-years.html)。已经坚持维护六年,内容持续更新,虽白菜价(**0.4元/天**)但质量很高,主打一个良心!

+如果觉得 JavaGuide 的内容对你有帮助的话,还请点个免费的 Star(绝不强制点 Star,觉得内容不错有收获再点赞就好),这是对我最大的鼓励,感谢各位一路同行,共勉!传送门:[GitHub](https://github.com/Snailclimb/JavaGuide) | [Gitee](https://gitee.com/SnailClimb/JavaGuide)。

-

-

+- **后端面试**:Java 基础、集合、并发、JVM、MySQL、Redis、分布式、系统设计等核心知识。

+- **AI 应用开发**:大模型(LLM)基础、Agent 智能体、RAG 检索增强生成、MCP 协议等前沿技术。

-## 面试辅导

+真心希望能够把这个项目做好,真正能够帮助到有需要的朋友!

-给自己打个小广告,如果需要面试辅导(比如简历优化、一对一提问、高频考点突击资料等),欢迎了解我的[知识星球](https://javaguide.cn/about-the-author/zhishixingqiu-two-years.html)。已经坚持维护六年,内容持续更新,虽白菜价(**0.4元/天**)但质量很高,主打一个良心!

+如果觉得 JavaGuide 的内容对你有帮助的话,还请点个免费的 Star(绝不强制点 Star,觉得内容不错有收获再点赞就好),这是对我最大的鼓励,感谢各位一路同行,共勉!传送门:[GitHub](https://github.com/Snailclimb/JavaGuide) | [Gitee](https://gitee.com/SnailClimb/JavaGuide)。

-

-  -

+- [项目介绍](./javaguide/intro.md)(JavaGuide 的诞生)

+- [贡献指南](./javaguide/contribution-guideline.md)(期待你的贡献,奖励丰富)

+- [常见问题](./javaguide/faq.md)(统一回复大家的一些疑问)

diff --git a/docs/about-the-author/README.md b/docs/about-the-author/README.md

index 12f6eab7f3f..43524d2ff58 100644

--- a/docs/about-the-author/README.md

+++ b/docs/about-the-author/README.md

@@ -1,5 +1,6 @@

---

title: 个人介绍 Q&A

+description: JavaGuide作者Guide个人介绍,19年本科毕业、大学期间变现20w+实现经济独立、坚持写博客的经历与收获分享。

category: 走近作者

---

diff --git a/docs/about-the-author/deprecated-java-technologies.md b/docs/about-the-author/deprecated-java-technologies.md

index 0146d71c4a3..84dc6e720b2 100644

--- a/docs/about-the-author/deprecated-java-technologies.md

+++ b/docs/about-the-author/deprecated-java-technologies.md

@@ -1,5 +1,6 @@

---

title: 已经淘汰的 Java 技术,不要再学了!

+description: 已淘汰的Java技术盘点,JSP、Struts、EJB、Java Applets、SOAP等过时技术不建议学习,附现代替代方案推荐。

category: 走近作者

tag:

- 杂谈

diff --git a/docs/about-the-author/dog-that-copies-other-people-essay.md b/docs/about-the-author/dog-that-copies-other-people-essay.md

index 653b616eaab..2ae67150843 100644

--- a/docs/about-the-author/dog-that-copies-other-people-essay.md

+++ b/docs/about-the-author/dog-that-copies-other-people-essay.md

@@ -1,5 +1,6 @@

---

title: 抄袭狗,你冬天睡觉脚必冷!!!

+description: 原创文章被抄袭的无奈经历,知乎、CSDN多平台盗文现象吐槽,分享如何屏蔽低质量内容和维护原创权益。

category: 走近作者

tag:

- 杂谈

diff --git a/docs/about-the-author/feelings-after-one-month-of-induction-training.md b/docs/about-the-author/feelings-after-one-month-of-induction-training.md

index ed57578a907..8ea32dd5c74 100644

--- a/docs/about-the-author/feelings-after-one-month-of-induction-training.md

+++ b/docs/about-the-author/feelings-after-one-month-of-induction-training.md

@@ -1,5 +1,6 @@

---

title: 入职培训一个月后的感受

+description: ThoughtWorks入职培训一个月感受,从Windows切换到Mac的适应、TWU培训内容、Feedback反馈文化等新人入职体验分享。

category: 走近作者

tag:

- 个人经历

diff --git a/docs/about-the-author/feelings-of-half-a-year-from-graduation-to-entry.md b/docs/about-the-author/feelings-of-half-a-year-from-graduation-to-entry.md

index cc9fe136749..d737f1a10b4 100644

--- a/docs/about-the-author/feelings-of-half-a-year-from-graduation-to-entry.md

+++ b/docs/about-the-author/feelings-of-half-a-year-from-graduation-to-entry.md

@@ -1,5 +1,6 @@

---

title: 从毕业到入职半年的感受

+description: 应届生入职半年的工作感受,CRUD业务代码的价值、技术积累靠工作之余、从学校到职场的转变心得分享。

category: 走近作者

tag:

- 个人经历

diff --git a/docs/about-the-author/internet-addiction-teenager.md b/docs/about-the-author/internet-addiction-teenager.md

index 78f94e2a483..82788023c3c 100644

--- a/docs/about-the-author/internet-addiction-teenager.md

+++ b/docs/about-the-author/internet-addiction-teenager.md

@@ -1,5 +1,6 @@

---

title: 我曾经也是网瘾少年

+description: 从网瘾少年到程序员的成长经历,初中沉迷游戏、高中觉醒奋起直追、高考失眠的真实故事,分享如何克服网瘾专注学习。

category: 走近作者

tag:

- 个人经历

diff --git a/docs/about-the-author/javaguide-100k-star.md b/docs/about-the-author/javaguide-100k-star.md

index e89060dbe27..da851386ee9 100644

--- a/docs/about-the-author/javaguide-100k-star.md

+++ b/docs/about-the-author/javaguide-100k-star.md

@@ -1,5 +1,6 @@

---

title: JavaGuide 开源项目 100K Star 了!

+description: JavaGuide开源项目达成100K Star里程碑,从2018年创建到突破十万星标的复盘总结,分享开源维护心得与未来规划。

category: 走近作者

tag:

- 个人经历

diff --git a/docs/about-the-author/my-article-was-stolen-and-made-into-video-and-it-became-popular.md b/docs/about-the-author/my-article-was-stolen-and-made-into-video-and-it-became-popular.md

index 2fa306d2fe9..67306b969fa 100644

--- a/docs/about-the-author/my-article-was-stolen-and-made-into-video-and-it-became-popular.md

+++ b/docs/about-the-author/my-article-was-stolen-and-made-into-video-and-it-became-popular.md

@@ -1,5 +1,6 @@

---

title: 某培训机构盗我文章做成视频还上了B站热门

+description: 原创文章被培训机构盗用制作成B站视频的维权经历,揭露培训机构剽窃原创引流的套路,呼吁尊重原创内容。

category: 走近作者

tag:

- 杂谈

diff --git a/docs/about-the-author/my-college-life.md b/docs/about-the-author/my-college-life.md

index 43d96bd4186..4df47ca785d 100644

--- a/docs/about-the-author/my-college-life.md

+++ b/docs/about-the-author/my-college-life.md

@@ -1,5 +1,6 @@

---

title: 害,毕业三年了!

+description: 双非一本程序员的大学四年,从参加社团活动到办补习班赚钱、确定Java后端方向、创建JavaGuide、最终拿到ThoughtWorks offer的真实经历。

category: 走近作者

star: 1

tag:

diff --git a/docs/about-the-author/writing-technology-blog-six-years.md b/docs/about-the-author/writing-technology-blog-six-years.md

index 9e18a67d8c4..b03faf75e76 100644

--- a/docs/about-the-author/writing-technology-blog-six-years.md

+++ b/docs/about-the-author/writing-technology-blog-six-years.md

@@ -1,5 +1,6 @@

---

title: 坚持写技术博客六年了!

+description: 坚持写技术博客六年的心得分享,写博客的好处、如何坚持下去、写哪些方向的博客、实用写作技巧等经验总结。

category: 走近作者

tag:

- 杂谈

diff --git a/docs/about-the-author/zhishixingqiu-two-years.md b/docs/about-the-author/zhishixingqiu-two-years.md

index dd0455a3f13..f1f7885390a 100644

--- a/docs/about-the-author/zhishixingqiu-two-years.md

+++ b/docs/about-the-author/zhishixingqiu-two-years.md

@@ -1,12 +1,13 @@

---

-title: 我的知识星球 4 岁了!

+title: 我的知识星球 6 岁了!

+description: JavaGuide知识星球介绍,提供Java面试指北专栏、简历修改、一对一答疑等服务,已帮助9000+球友提升求职竞争力。

category: 知识星球

star: 2

---

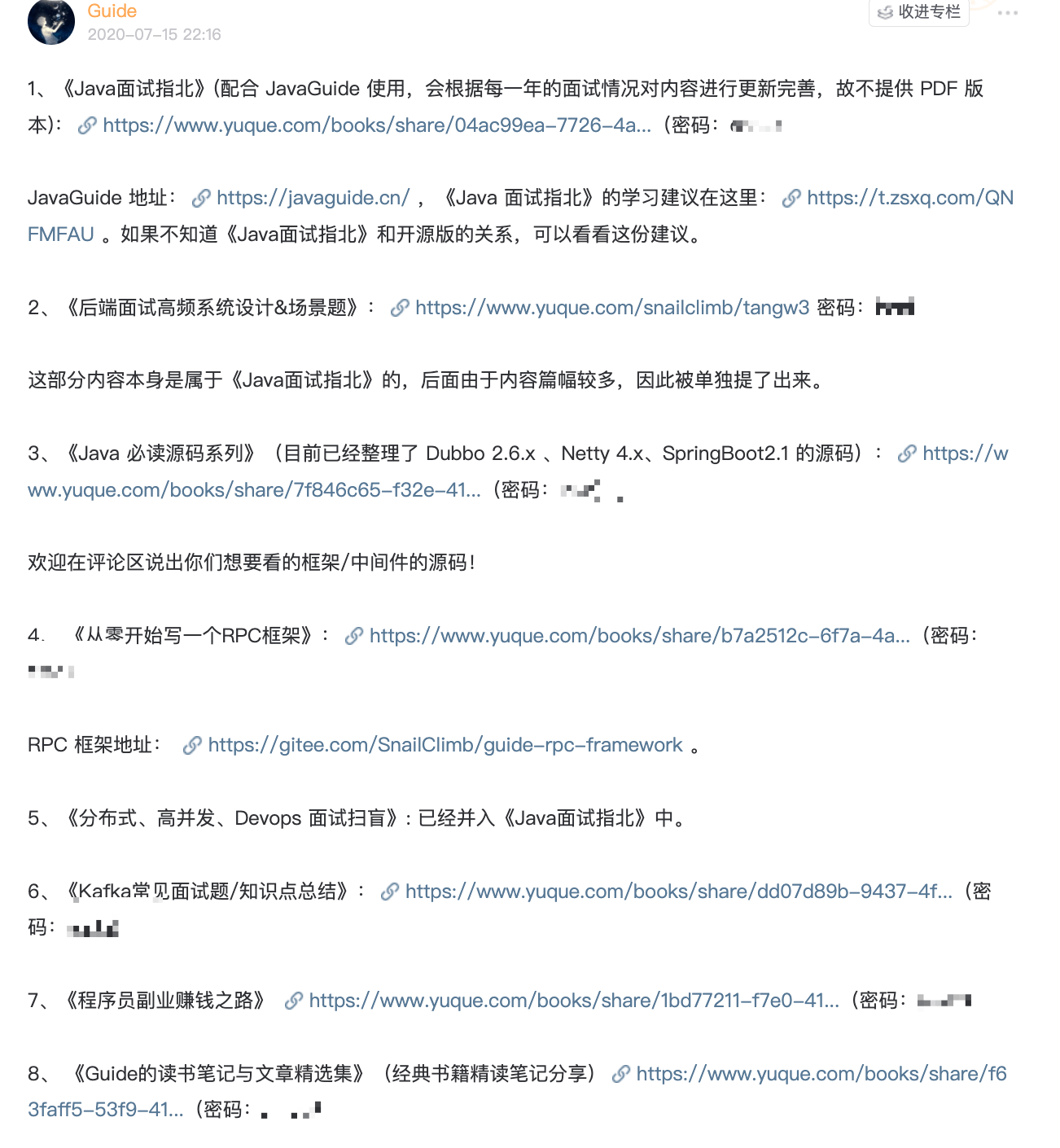

在 **2019 年 12 月 29 号**,经过了大概一年左右的犹豫期,我正式确定要开始做一个自己的星球,帮助学习 Java 和准备 Java 面试的同学。一转眼,已经六年了。感谢大家一路陪伴,我会信守承诺,继续认真维护这个纯粹的 Java 知识星球,不让信任我的读者失望。

-

+

我是比较早一批做星球的技术号主,也是坚持做下来的那一少部人(大部分博主割一波韭菜就不维护星球了)。最开始的一两年,纯粹靠爱发电。当初定价非常低(一顿饭钱),加上刚工作的时候比较忙,提供的服务也没有现在这么多。

@@ -46,29 +47,34 @@ star: 2

- **独家面试手册**:多本原创 PDF 后端面试手册免费领取,全网独家。

- **有问必答**:一对一免费提问,提供专属求职指南,拒绝焦虑。

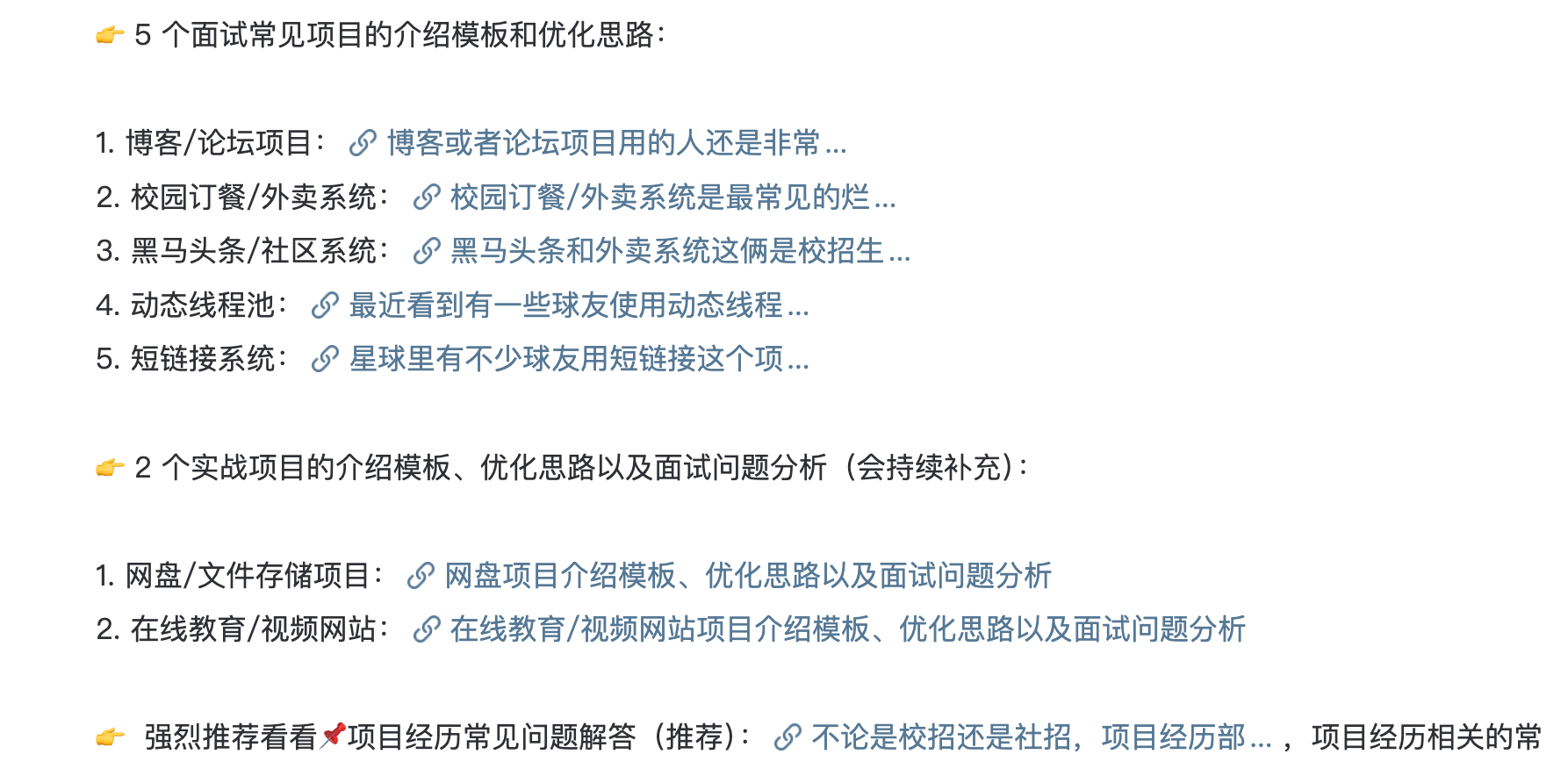

+**🚀 实战项目**

+

+星球已经推出的实战项目如下:

+

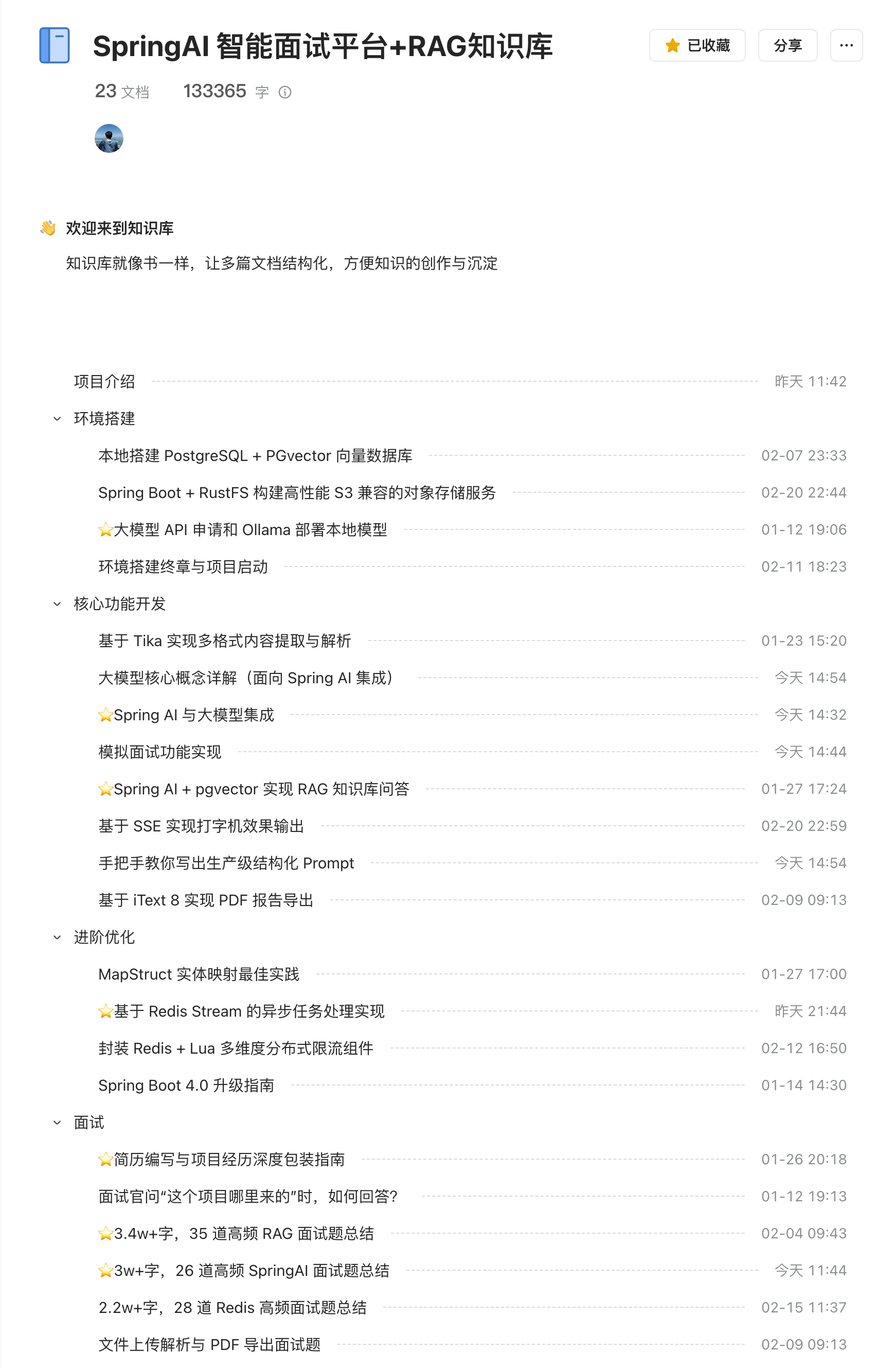

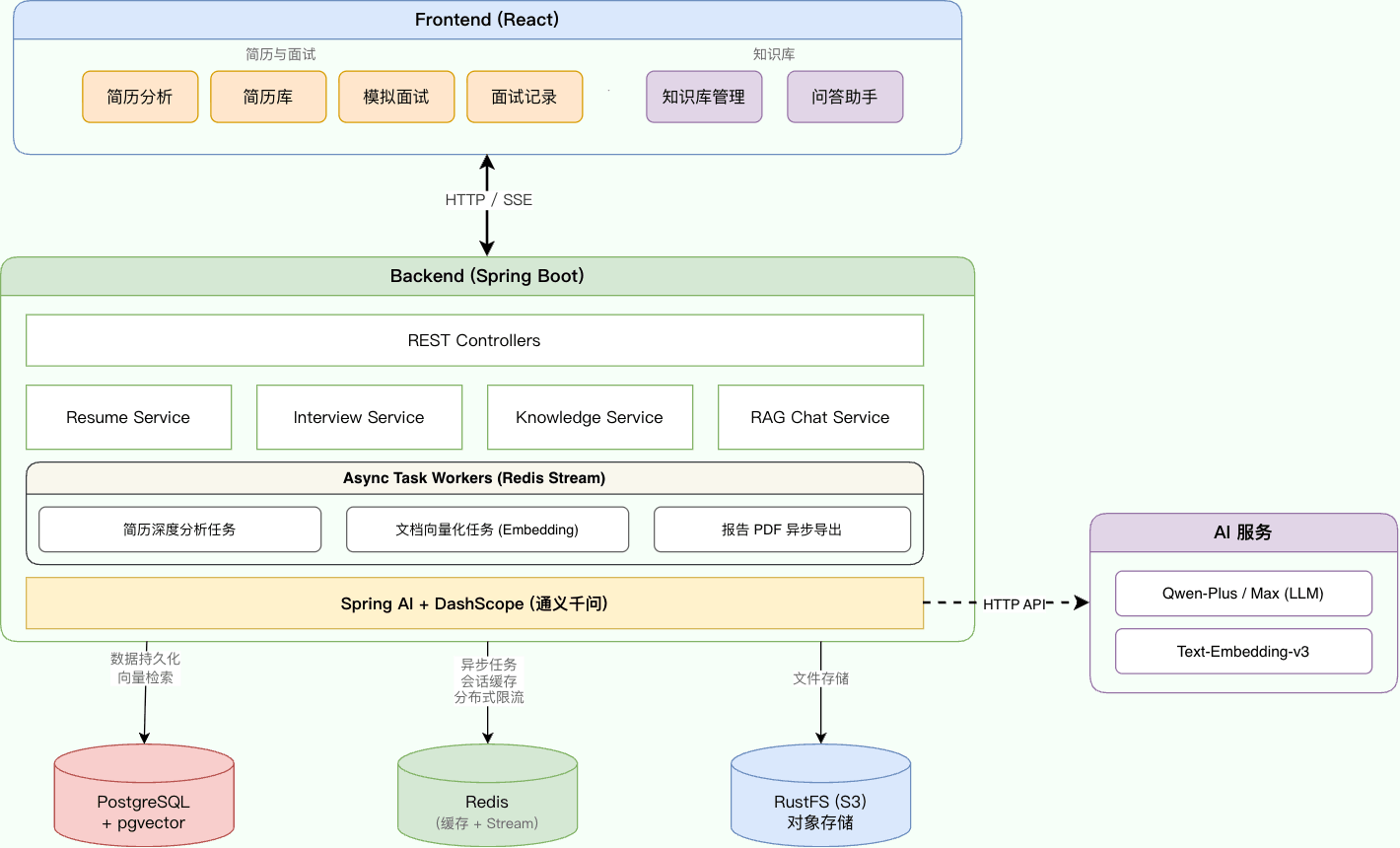

+- [⭐AI 智能面试辅助平台 + RAG 知识库](https://javaguide.cn/zhuanlan/interview-guide.html):基于 Spring Boot 4.0 + Java 21 + Spring AI 2.0 开发。非常适合作为学习和简历项目,学习门槛低,帮助提升求职竞争力,是主打就业的实战项目。

+- [手写 RPC 框架](https://javaguide.cn/zhuanlan/handwritten-rpc-framework.html):从零开始基于 Netty+Kyro+Zookeeper 实现一个简易的 RPC 框架。麻雀虽小五脏俱全,项目代码注释详细,结构清晰。

+

+今年陆续还会推出更多企业级实战案例(预告一下,下一个是大家期待的:**企业智能客服**)!

+

🔥 **氛围与福利**

- **海量资源**:Java 优质面试资源持续更新分享。

- **抱团成长**:打卡活动、读书交流、线下聚会,让学习之路不再孤单。

- **惊喜福利**:不定期节日抽奖、送书送课,福利拿到手软。

-🚀 **拥抱 AI**

-

-星球目前正在深度分享 **AI 编程** 方法论,并计划推出 **AI 实战项目**。

-

💡 **总结**:这里的任何一项服务(尤其是简历修改和面试资料),单独拎出来的价值都已远超星球门票。

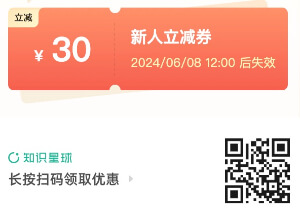

-这里赠送一个 **30** 元的星球新人专属优惠券(数量有限,价格即将上调)!

+目前星球正在做活动,两本书的价格,就能让你拥有上万培训班的服务!

-

+这里再提供一张 **30**元的优惠卷(**价格马上上调,老用户扫码续费半价** ):

-老用户续费可以添加微信(**javaguide1024**)领取一个半价基础基础上的续费优惠卷,记得备注 **“续费”** 。

+

### 专属专栏

星球更新了 **《Java 面试指北》**、**《Java 必读源码系列》**(目前已经整理了 Dubbo 2.6.x、Netty 4.x、SpringBoot2.1 的源码)、 **《从零开始写一个 RPC 框架》**(已更新完)、**《Kafka 常见面试题/知识点总结》** 等多个优质专栏。

-

+

《Java 面试指北》内容概览:

@@ -76,6 +82,17 @@ star: 2

进入星球之后,这些专栏即可免费永久阅读,永久同步更新!

+### 实战项目

+

+星球已经推出的实战项目如下:

+

+- [⭐AI 智能面试辅助平台 + RAG 知识库](https://javaguide.cn/zhuanlan/interview-guide.html):基于 Spring Boot 4.0 + Java 21 + Spring AI 2.0 开发。非常适合作为学习和简历项目,学习门槛低,帮助提升求职竞争力,是主打就业的实战项目。

+- [手写 RPC 框架](https://javaguide.cn/zhuanlan/handwritten-rpc-framework.html):从零开始基于 Netty+Kyro+Zookeeper 实现一个简易的 RPC 框架。麻雀虽小五脏俱全,项目代码注释详细,结构清晰。

+

+今年陆续还会推出更多企业级实战案例!并且,星球还分享了很多高频项目经历的优化版介绍和面试准备(持续更新中)。

+

+

+

### PDF 面试手册

进入星球就免费赠送多本优质 PDF 面试手册。

@@ -120,7 +137,7 @@ JavaGuide 知识星球优质主题汇总传送门:

-

+- [项目介绍](./javaguide/intro.md)(JavaGuide 的诞生)

+- [贡献指南](./javaguide/contribution-guideline.md)(期待你的贡献,奖励丰富)

+- [常见问题](./javaguide/faq.md)(统一回复大家的一些疑问)

diff --git a/docs/about-the-author/README.md b/docs/about-the-author/README.md

index 12f6eab7f3f..43524d2ff58 100644

--- a/docs/about-the-author/README.md

+++ b/docs/about-the-author/README.md

@@ -1,5 +1,6 @@

---

title: 个人介绍 Q&A

+description: JavaGuide作者Guide个人介绍,19年本科毕业、大学期间变现20w+实现经济独立、坚持写博客的经历与收获分享。

category: 走近作者

---

diff --git a/docs/about-the-author/deprecated-java-technologies.md b/docs/about-the-author/deprecated-java-technologies.md

index 0146d71c4a3..84dc6e720b2 100644

--- a/docs/about-the-author/deprecated-java-technologies.md

+++ b/docs/about-the-author/deprecated-java-technologies.md

@@ -1,5 +1,6 @@

---

title: 已经淘汰的 Java 技术,不要再学了!

+description: 已淘汰的Java技术盘点,JSP、Struts、EJB、Java Applets、SOAP等过时技术不建议学习,附现代替代方案推荐。

category: 走近作者

tag:

- 杂谈

diff --git a/docs/about-the-author/dog-that-copies-other-people-essay.md b/docs/about-the-author/dog-that-copies-other-people-essay.md

index 653b616eaab..2ae67150843 100644

--- a/docs/about-the-author/dog-that-copies-other-people-essay.md

+++ b/docs/about-the-author/dog-that-copies-other-people-essay.md

@@ -1,5 +1,6 @@

---

title: 抄袭狗,你冬天睡觉脚必冷!!!

+description: 原创文章被抄袭的无奈经历,知乎、CSDN多平台盗文现象吐槽,分享如何屏蔽低质量内容和维护原创权益。

category: 走近作者

tag:

- 杂谈

diff --git a/docs/about-the-author/feelings-after-one-month-of-induction-training.md b/docs/about-the-author/feelings-after-one-month-of-induction-training.md

index ed57578a907..8ea32dd5c74 100644

--- a/docs/about-the-author/feelings-after-one-month-of-induction-training.md

+++ b/docs/about-the-author/feelings-after-one-month-of-induction-training.md

@@ -1,5 +1,6 @@

---

title: 入职培训一个月后的感受

+description: ThoughtWorks入职培训一个月感受,从Windows切换到Mac的适应、TWU培训内容、Feedback反馈文化等新人入职体验分享。

category: 走近作者

tag:

- 个人经历

diff --git a/docs/about-the-author/feelings-of-half-a-year-from-graduation-to-entry.md b/docs/about-the-author/feelings-of-half-a-year-from-graduation-to-entry.md

index cc9fe136749..d737f1a10b4 100644

--- a/docs/about-the-author/feelings-of-half-a-year-from-graduation-to-entry.md

+++ b/docs/about-the-author/feelings-of-half-a-year-from-graduation-to-entry.md

@@ -1,5 +1,6 @@

---

title: 从毕业到入职半年的感受

+description: 应届生入职半年的工作感受,CRUD业务代码的价值、技术积累靠工作之余、从学校到职场的转变心得分享。

category: 走近作者

tag:

- 个人经历

diff --git a/docs/about-the-author/internet-addiction-teenager.md b/docs/about-the-author/internet-addiction-teenager.md

index 78f94e2a483..82788023c3c 100644

--- a/docs/about-the-author/internet-addiction-teenager.md

+++ b/docs/about-the-author/internet-addiction-teenager.md

@@ -1,5 +1,6 @@

---

title: 我曾经也是网瘾少年

+description: 从网瘾少年到程序员的成长经历,初中沉迷游戏、高中觉醒奋起直追、高考失眠的真实故事,分享如何克服网瘾专注学习。

category: 走近作者

tag:

- 个人经历

diff --git a/docs/about-the-author/javaguide-100k-star.md b/docs/about-the-author/javaguide-100k-star.md

index e89060dbe27..da851386ee9 100644

--- a/docs/about-the-author/javaguide-100k-star.md

+++ b/docs/about-the-author/javaguide-100k-star.md

@@ -1,5 +1,6 @@

---

title: JavaGuide 开源项目 100K Star 了!

+description: JavaGuide开源项目达成100K Star里程碑,从2018年创建到突破十万星标的复盘总结,分享开源维护心得与未来规划。

category: 走近作者

tag:

- 个人经历

diff --git a/docs/about-the-author/my-article-was-stolen-and-made-into-video-and-it-became-popular.md b/docs/about-the-author/my-article-was-stolen-and-made-into-video-and-it-became-popular.md

index 2fa306d2fe9..67306b969fa 100644

--- a/docs/about-the-author/my-article-was-stolen-and-made-into-video-and-it-became-popular.md

+++ b/docs/about-the-author/my-article-was-stolen-and-made-into-video-and-it-became-popular.md

@@ -1,5 +1,6 @@

---

title: 某培训机构盗我文章做成视频还上了B站热门

+description: 原创文章被培训机构盗用制作成B站视频的维权经历,揭露培训机构剽窃原创引流的套路,呼吁尊重原创内容。

category: 走近作者

tag:

- 杂谈

diff --git a/docs/about-the-author/my-college-life.md b/docs/about-the-author/my-college-life.md

index 43d96bd4186..4df47ca785d 100644

--- a/docs/about-the-author/my-college-life.md

+++ b/docs/about-the-author/my-college-life.md

@@ -1,5 +1,6 @@

---

title: 害,毕业三年了!

+description: 双非一本程序员的大学四年,从参加社团活动到办补习班赚钱、确定Java后端方向、创建JavaGuide、最终拿到ThoughtWorks offer的真实经历。

category: 走近作者

star: 1

tag:

diff --git a/docs/about-the-author/writing-technology-blog-six-years.md b/docs/about-the-author/writing-technology-blog-six-years.md

index 9e18a67d8c4..b03faf75e76 100644

--- a/docs/about-the-author/writing-technology-blog-six-years.md

+++ b/docs/about-the-author/writing-technology-blog-six-years.md

@@ -1,5 +1,6 @@

---

title: 坚持写技术博客六年了!

+description: 坚持写技术博客六年的心得分享,写博客的好处、如何坚持下去、写哪些方向的博客、实用写作技巧等经验总结。

category: 走近作者

tag:

- 杂谈

diff --git a/docs/about-the-author/zhishixingqiu-two-years.md b/docs/about-the-author/zhishixingqiu-two-years.md

index dd0455a3f13..f1f7885390a 100644

--- a/docs/about-the-author/zhishixingqiu-two-years.md

+++ b/docs/about-the-author/zhishixingqiu-two-years.md

@@ -1,12 +1,13 @@

---

-title: 我的知识星球 4 岁了!

+title: 我的知识星球 6 岁了!

+description: JavaGuide知识星球介绍,提供Java面试指北专栏、简历修改、一对一答疑等服务,已帮助9000+球友提升求职竞争力。

category: 知识星球

star: 2

---

在 **2019 年 12 月 29 号**,经过了大概一年左右的犹豫期,我正式确定要开始做一个自己的星球,帮助学习 Java 和准备 Java 面试的同学。一转眼,已经六年了。感谢大家一路陪伴,我会信守承诺,继续认真维护这个纯粹的 Java 知识星球,不让信任我的读者失望。

-

+

我是比较早一批做星球的技术号主,也是坚持做下来的那一少部人(大部分博主割一波韭菜就不维护星球了)。最开始的一两年,纯粹靠爱发电。当初定价非常低(一顿饭钱),加上刚工作的时候比较忙,提供的服务也没有现在这么多。

@@ -46,29 +47,34 @@ star: 2

- **独家面试手册**:多本原创 PDF 后端面试手册免费领取,全网独家。

- **有问必答**:一对一免费提问,提供专属求职指南,拒绝焦虑。

+**🚀 实战项目**

+

+星球已经推出的实战项目如下:

+

+- [⭐AI 智能面试辅助平台 + RAG 知识库](https://javaguide.cn/zhuanlan/interview-guide.html):基于 Spring Boot 4.0 + Java 21 + Spring AI 2.0 开发。非常适合作为学习和简历项目,学习门槛低,帮助提升求职竞争力,是主打就业的实战项目。

+- [手写 RPC 框架](https://javaguide.cn/zhuanlan/handwritten-rpc-framework.html):从零开始基于 Netty+Kyro+Zookeeper 实现一个简易的 RPC 框架。麻雀虽小五脏俱全,项目代码注释详细,结构清晰。

+

+今年陆续还会推出更多企业级实战案例(预告一下,下一个是大家期待的:**企业智能客服**)!

+

🔥 **氛围与福利**

- **海量资源**:Java 优质面试资源持续更新分享。

- **抱团成长**:打卡活动、读书交流、线下聚会,让学习之路不再孤单。

- **惊喜福利**:不定期节日抽奖、送书送课,福利拿到手软。

-🚀 **拥抱 AI**

-

-星球目前正在深度分享 **AI 编程** 方法论,并计划推出 **AI 实战项目**。

-

💡 **总结**:这里的任何一项服务(尤其是简历修改和面试资料),单独拎出来的价值都已远超星球门票。

-这里赠送一个 **30** 元的星球新人专属优惠券(数量有限,价格即将上调)!

+目前星球正在做活动,两本书的价格,就能让你拥有上万培训班的服务!

-

+这里再提供一张 **30**元的优惠卷(**价格马上上调,老用户扫码续费半价** ):

-老用户续费可以添加微信(**javaguide1024**)领取一个半价基础基础上的续费优惠卷,记得备注 **“续费”** 。

+

### 专属专栏

星球更新了 **《Java 面试指北》**、**《Java 必读源码系列》**(目前已经整理了 Dubbo 2.6.x、Netty 4.x、SpringBoot2.1 的源码)、 **《从零开始写一个 RPC 框架》**(已更新完)、**《Kafka 常见面试题/知识点总结》** 等多个优质专栏。

-

+

《Java 面试指北》内容概览:

@@ -76,6 +82,17 @@ star: 2

进入星球之后,这些专栏即可免费永久阅读,永久同步更新!

+### 实战项目

+

+星球已经推出的实战项目如下:

+

+- [⭐AI 智能面试辅助平台 + RAG 知识库](https://javaguide.cn/zhuanlan/interview-guide.html):基于 Spring Boot 4.0 + Java 21 + Spring AI 2.0 开发。非常适合作为学习和简历项目,学习门槛低,帮助提升求职竞争力,是主打就业的实战项目。

+- [手写 RPC 框架](https://javaguide.cn/zhuanlan/handwritten-rpc-framework.html):从零开始基于 Netty+Kyro+Zookeeper 实现一个简易的 RPC 框架。麻雀虽小五脏俱全,项目代码注释详细,结构清晰。

+

+今年陆续还会推出更多企业级实战案例!并且,星球还分享了很多高频项目经历的优化版介绍和面试准备(持续更新中)。

+

+

+

### PDF 面试手册

进入星球就免费赠送多本优质 PDF 面试手册。

@@ -120,7 +137,7 @@ JavaGuide 知识星球优质主题汇总传送门:VS Code / Cursor"]:::client + end + + subgraph Layer["MCP 层"] + direction LR + style Layer fill:#F5F7FA,color:#333333,stroke:#005D7B,stroke-width:2px + MCPClient["MCP Client

(连接管理)"]:::infra --> MCPServer["MCP Server

(功能接口)"]:::business + end + + subgraph Data["数据源层"] + direction LR + style Data fill:#F5F7FA,color:#333333,stroke:#005D7B,stroke-width:2px + LocalFiles["本地文件

Git 仓库"]:::storage + ExternalAPI["外部 API

GitHub / 天气"]:::storage + end + + App --> MCPClient + MCPServer --> LocalFiles + MCPServer --> ExternalAPI + + linkStyle default stroke-width:2px,stroke:#333333,opacity:0.8 +``` + +**组件详解:** + +| 组件 | 定位 | 职责 | 代表产品 | 失败路径与性能指标 | +| --------------- | ----------- | ----------------------------------------------- | -------------------------------------------- | ----------------------------------------------------------------------------------------------------------------------------- | +| **MCP Host** | 用户交互层 | 运行 AI 应用,托管 LLM,管理 MCP Client | Claude Desktop v1.0、VS Code (Cline)、Cursor | Server 崩溃时需自动重连;建议支持 50+ 并发 Server 连接 | +| **MCP Client** | 连接管理层 | 与 MCP Server 建立 1:1 连接,转发 JSON-RPC 请求 | 集成在 Host 内部 | **失败路径**:断连时需指数退避重连(初始 1s,最大 60s);**性能指标**:连接建立 P99 < 100ms | +| **MCP Server** | 能力暴露层 | 实现 MCP 协议,暴露 Resources/Tools 等能力 | 开发者使用 SDK 开发 | **失败路径**:资源不存在返回 `-32004`,权限不足返回 `-32003`;**性能指标**:Tool 调用 P99 < 200ms,Resources 加载 P99 < 500ms | +| **Data Source** | 数据/服务层 | 提供实际数据或执行操作 | 文件系统、数据库、外部 API | 需实现连接池和熔断,防止级联故障 | + +**重要特性:** + +1. **一对多关系**:一个 Host 可以管理多个 Client,每个 Client 对应一个 Server +2. **解耦设计**:Client 和 Server 通过 JSON-RPC 通信,不依赖具体实现 +3. **多实例支持**:可以同时连接多个不同功能的 MCP Server + +> 🐛 **常见误区**: +> +> 很多开发者认为 Host 直接连接 Server。实际上,Host 内部会为每个配置的 Server 创建独立的 Client 实例。这种设计使得不同 Server 之间的连接互不影响。 + +### ⭐️ 请描述 MCP 的完整工作流程 + +MCP 的工作流程可以分为 **7 个步骤**: + +```mermaid +sequenceDiagram + participant U as User + participant H as Host (LLM) + participant C as MCP Client + participant S as MCP Server + participant D as Data Source + + U->>H: 提问: "分析这个仓库的最新提交" + H->>H: 思考 (Chain of Thought) + H->>C: Call Tool: list_commits() + C->>S: JSON-RPC Request

{method: "tools/call", params: ...} + S->>D: Fetch Git Logs + D-->>S: Return Logs + S-->>C: JSON-RPC Response

{result: ...} + C-->>H: Tool Output + H->>H: 思考与总结 + H-->>U: 返回分析结果 +``` + +**步骤详解:** + +| 步骤 | 描述 | 关键点 | +| ------------------ | ------------------------------------ | ------------------------------ | +| **1. 用户请求** | 用户通过 Host 发送问题 | Host 首先接收用户输入 | +| **2. LLM 推理** | Host 内部的 LLM 判断是否需要外部能力 | 使用 Chain of Thought 进行思考 | +| **3. 工具调用** | LLM 决定调用哪个 Tool | 通过 Client 发起调用 | +| **4. 协议转换** | Client 将调用转换为 JSON-RPC 请求 | 标准化的消息格式 | +| **5. Server 处理** | MCP Server 解析请求并访问数据源 | 业务逻辑的真正执行者 | +| **6. 数据返回** | 结果沿原路返回给 LLM | JSON-RPC Response | +| **7. 最终生成** | LLM 结合工具结果生成最终回复 | 用户体验的核心环节 | + +### MCP 使用什么通信协议? + +#### JSON-RPC 2.0 + +MCP 采用 **JSON-RPC 2.0** 作为应用层通信协议,原因如下: + +| 优势 | 说明 | +| ------------ | ---------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------- | +| **轻量级** | 相比 gRPC,JSON-RPC 无需通过 Protobuf 进行额外的跨语言编译和桩代码生成,降低了接入阻力。但作为 Trade-off,JSON-RPC 缺乏原生的强类型约束,MCP 必须在应用层强依赖 JSON Schema 对 Tool 的入参进行严格的结构化声明与运行时校验。 | +| **传输无关** | 可以运行在 stdio、HTTP、WebSocket 等多种传输层之上 | +| **易调试** | 纯文本格式,便于人工阅读和调试 | +| **广泛支持** | 几乎所有编程语言都有成熟的 JSON-RPC 库 | + +**JSON-RPC 消息格式:** + +```json +// 请求 +{ + "jsonrpc": "2.0", + "method": "tools/call", + "params": { + "name": "read_file", + "arguments": { "path": "/path/to/file.txt" } + }, + "id": 1 +} + +// 响应 +{ + "jsonrpc": "2.0", + "id": 1, + "result": { + "content": [ + { + "type": "text", + "text": "文件内容..." + } + ] + }, + "error": null // error 和 result 互斥 +} +``` + +#### JSON-RPC vs HTTP + +| 对比维度 | HTTP (RESTful) | JSON-RPC | +| ------------ | ---------------------------- | -------------------------- | +| **语义模型** | 面向资源 (Resource-Oriented) | 面向操作 (Action-Oriented) | +| **调用方式** | GET/POST/PUT/DELETE + URI | method 名 + 参数 | +| **数据格式** | 灵活 (JSON/XML/HTML) | 严格 JSON | +| **功能特性** | 丰富 (状态码/缓存/重定向) | 极简 (仅 RPC 规范) | +| **适用场景** | 公开 API、Web 服务 | 内部通信、工具调用 | + +> 🌈 **拓展阅读**: +> +> - [JSON-RPC 2.0 官方规范](https://www.jsonrpc.org/specification) +> - [A gRPC transport for the Model Context Protocol](https://cloud.google.com/blog/products/networking/grpc-as-a-native-transport-for-mcp) + +### ⭐️ MCP 支持哪些传输方式? + +#### stdio(标准输入/输出) + +| 特性 | 说明 | +| ------------ | ------------------------------------------------------- | +| **适用场景** | 本地进程间通信 (IPC) | +| **实现方式** | Host 启动 MCP Server 作为子进程,通过 stdin/stdout 通信 | +| **优势** | 极度轻量,无网络开销,启动快 | +| **典型应用** | Claude Desktop、本地 IDE 插件 | + +**安全提示**:stdio 模式下 MCP Server 与 Host 同权限,恶意 Server 可读取任意文件。生产环境必须采用以下防护措施: + +- **系统级隔离**:引入基于 **cgroups** 与 **namespace** 的沙箱(如 Docker/gVisor),建议限制 **CPU < 10%** 配额、内存 < 512MB,防止资源耗尽。 +- **进程管理**:配置子进程的 **SIGTERM/SIGKILL** 优雅退出钩子,防止僵尸进程和文件描述符泄漏。 +- **源码审计**:审阅社区 Server 的源代码,只使用可信来源的 Server;建议建立沙箱突破审计日志。 +- **网络限制**:沙箱内禁止出站网络连接,防范数据外泄。 + +**Streamable HTTP 模式增强安全**: + +- **认证机制**:每条请求携带标准 `Authorization` 头,支持 OAuth 2.0 或 API Key 认证(旧版 HTTP+SSE 只在建立 SSE 连接时校验一次,后续请求无法逐条鉴权)。 +- **传输加密**:强制 TLS 1.3,防止中间人攻击。 +- **访问控制**:基于 RBAC 限制 Resources 和 Tools 的访问权限。 + +#### Streamable HTTP(推荐) + +> MCP 协议版本 `2025-03-26` 正式引入 Streamable HTTP 传输方式,取代了旧版的 HTTP+SSE。旧版 HTTP+SSE 使用两个端点(`/sse` 持久连接 + `/sse/messages` 发送消息),已**标记为废弃**,不建议在新项目中使用。 + +| 特性 | 说明 | +| -------------- | --------------------------------------------------------------------------------------------------------- | +| **适用场景** | 远程部署、独立服务、生产环境 | +| **实现方式** | 单端点(如 `/mcp`),客户端 POST 发送 JSON-RPC 请求,服务端按需返回 JSON 响应或 SSE 流 | +| **优势** | 标准兼容性好(负载均衡器、API 网关、CORS 中间件开箱即用),每条请求独立鉴权,无需维护长连接 | +| **典型应用** | Web 应用、团队共享的 MCP 服务、云端托管 MCP Server | + +**Streamable HTTP 核心机制**: + +| 能力 | 说明 | +| ---------------- | -------------------------------------------------------------------------------------------------------- | +| **单端点交互** | 所有客户端→服务端消息通过 POST 发送到同一端点(如 `https://example.com/mcp`) | +| **灵活响应** | 服务端返回 `application/json`(简单请求-响应)或 `text/event-stream`(流式推送,如进度通知) | +| **会话管理** | 通过 `Mcp-Session-Id` 响应头分配会话 ID,客户端在后续请求中携带 | +| **可恢复性** | 基于 SSE 事件 ID + `Last-Event-ID` 请求头实现断线重连后消息补发 | +| **服务端推送** | 客户端可通过 GET 请求打开独立 SSE 流,接收服务端主动推送的通知和请求(可选能力) | + +**Streamable HTTP vs 旧版 HTTP+SSE 对比**: + +| 对比维度 | 旧版 HTTP+SSE(已废弃) | Streamable HTTP(当前推荐) | +| ------------ | ---------------------------------------------- | ------------------------------------------------- | +| **端点数量** | 两个(`/sse` + `/sse/messages`) | 一个(如 `/mcp`) | +| **连接模型** | 必须维护持久 SSE 连接 | 标准 HTTP 请求-响应,SSE 可选 | +| **认证** | 仅连接建立时校验,后续无法逐条鉴权 | 每条 POST 请求携带 `Authorization` 头,逐条鉴权 | +| **基础设施** | 需要粘性会话,与负载均衡器/API 网关兼容性差 | 与标准 HTTP 基础设施天然兼容 | +| **会话管理** | 非正式化 | `Mcp-Session-Id` 头,生命周期明确 | + +**选型决策**: + + + +#### 传输层异常与背压分析(生产级考量) + +| 风险类型 | stdio 模式 | Streamable HTTP 模式 | 工程防御手段 | +| ------------------------ | --------------------------------------------------------------------- | ---------------------------------- | ---------------------------------------------------------- | +| **子进程僵死** | 高:Server 异常退出时,Host 可能未正确回收子进程,产生 Zombie Process | 低:无子进程概念 | 配置 `SIGCHLD` 信号处理器 + `waitpid` 兜底回收 | +| **文件描述符泄漏** | 高:stdin/stdout 管道未关闭会导致 FD Leak,最终耗尽系统资源 | 低:标准 HTTP 连接,框架自动管理 | 设置 FD 上限(`ulimit -n`),实现连接池健康检查 | +| **连接中断** | 中:Server 崩溃导致管道断裂 | 低:每次请求独立,天然容错 | 指数退避重试 + 熔断机制(Circuit Breaker) | +| **背压(Backpressure)** | 缺失:stdio 无流量控制机制 | 原生支持:HTTP 状态码控制流量 | 实现滑动窗口限流,超出缓冲区时返回 `429 Too Many Requests` | + +## 工程实践 + +### 开发 MCP Server 时有哪些最佳实践? + +#### 1. 工具粒度设计 (Tool Granularity) + +**原则:单一职责,语义明确** + +| 反面示例 | 正面示例 | +| -------------------------------- | ---------------------------------------------------------- | +| `execute_sql(sql)` | `get_user_by_id(id)` / `list_active_orders()` | +| `file_operation(op, path, data)` | `read_file(path)` / `write_file(path, content)` | +| `database(action, params)` | `query_userByEmail(email)` / `updateUserProfile(id, data)` | + +**设计建议**: + +- 工具名称使用**动词+名词**形式:`get_`、`list_`、`create_`、`update_`、`delete_`。 +- 参数类型要**明确且可验证**:使用 JSON Schema 定义`。 +- 避免过度抽象:不要把多个操作塞进一个工具`。 + +#### 2. Context Window 管理 + +MCP 的 Resources 能力可能一次性加载大量文本,导致: + +| 问题 | 后果 | 解决方案 | +| -------------- | ---------------------------------------- | --------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------------- | +| 上下文溢出 | LLM 无法处理完整内容 | 实现**分块 (Chunking)** 逻辑 | +| 中间丢失 | LLM 忽略上下文中间的内容 | 提供**摘要 (Summarization)** | +| 成本过高 | Token 消耗过大 | 实现**按需加载**和**增量同步** | +| **OOM 风险** | **内存溢出导致 Server 被 Kill** | **严格限制单条资源大小(如 < 10MB),超出时返回元数据而非全文** | +| **Token 爆炸** | **超出上下文窗口触发截断,丢失关键信息** | **限制绝对字符长度(如 < 1MB)、返回分页元数据,或依赖 Host 端的 Context Window 截断机制**。**注意:** 由于 MCP Server 是模型无感知的,严禁硬编码特定模型的 Tokenizer(如 `tiktoken`)进行预计算,否则接入其他 LLM 平台时会失效。 | + +#### 3. 错误处理与用户体验 + +| 错误类型 | 处理方式 | +| ------------------ | -------------------------- | +| **参数验证失败** | 返回清晰的错误提示和建议 | +| **权限不足** | 说明所需权限和申请方式 | +| **服务暂时不可用** | 提供重试机制和预计恢复时间 | +| **部分失败** | 明确哪些操作成功、哪些失败 | + +#### 4. 安全防护 + +| 风险 | 防护措施 | +| ---------------- | ---------------------------- | +| **路径遍历攻击** | 验证文件路径,限制访问目录 | +| **SQL 注入** | 使用参数化查询,禁止拼接 SQL | +| **敏感信息泄露** | 脱敏处理,避免返回完整凭证 | +| **资源滥用** | 实现速率限制和配额管理 | + +#### 5. 调试与监控 + +**推荐工具**: + +- [**MCP Inspector**](https://modelcontextprotocol.io/docs/tools/inspector):官方调试工具,可模拟 Host 发送请求 + + ```bash + npx @modelcontextprotocol/inspector node my-server.js + ``` + +- **日志记录**:记录所有 JSON-RPC 请求和响应 +- **性能监控**:跟踪响应时间、错误率、Token 消耗 +- **健康检查**:实现 `/health` 端点用于监控 + +### 如何开发一个自定义的 MCP 服务器? + +**开发流程:** + +``` +1. 选择 SDK + ├─ TypeScript (官方首选) + ├─ Python + └─ Java (Spring AI) + +2. 定义能力 + ├─ Resources: 暴露哪些数据? + ├─ Tools: 提供哪些功能? + └─ Prompts: 有哪些常用操作模板? + +3. 实现业务逻辑 + └─ 连接数据源/服务,实现具体功能 + +4. 本地测试 + └─ 使用 MCP Inspector 验证 + +5. 部署配置 + └─ 在 Host 中配置 Server 启动命令 +``` + +**快速示例 (Python SDK):** + +```python +from mcp.server import Server +from mcp.types import Tool, TextContent + +# 创建 Server 实例 +server = Server("my-mcp-server") + +# 定义 Tool +@server.tool() +async def get_weather(city: str) -> str: + """获取指定城市的天气信息""" + # 实际业务逻辑 + return f"{city} 今天晴天,温度 25°C" + +# 定义 Resource +@server.resource("weather://forecast") +async def weather_forecast() -> str: + """返回未来一周天气预报""" + return "未来七天天气预报..." + +# 启动 Server +if __name__ == "__main__": + server.run() +``` + +**配置示例 (Claude Desktop):** + +```json +{ + "mcpServers": { + "my-server": { + "command": "python", + "args": ["/path/to/my_server.py"], + "env": { + "API_KEY": "your-api-key" + } + } + } +} +``` + +> ⚠️ **工程提示**:在生产环境中,Python MCP Server 依赖 `mcp` SDK,直接使用全局 `python` 命令会因依赖缺失而启动失败。请使用虚拟环境中的 Python 解释器路径(如 `/path/to/venv/bin/python`),或推荐使用现代化包管理器(如 `uvx` 或 `npx`),例如: +> +> ```json +> { +> "command": "uvx", +> "args": ["--from", "mcp", "python", "/path/to/my_server.py"] +> } +> ``` +> +> 启动失败时,可查看 Claude Desktop 的 `mcp.log` 排查问题。 + +## 拓展阅读 + +### 官方资源 + +- [MCP 官方文档](https://modelcontextprotocol.io/) +- [MCP GitHub 仓库](https://github.com/modelcontextprotocol) +- [MCP Inspector 调试工具](https://github.com/modelcontextprotocol/inspector) + +### 社区资源 + +- [Awesome MCP Servers](https://github.com/punkpeye/awesome-mcp-servers) +- [MCP 官方 SDK](https://github.com/modelcontextprotocol/servers) + +### 推荐文章 + +1. [从原理到示例:Java开发玩转MCP - 阿里云开发者](https://mp.weixin.qq.com/s/TYoJ9mQL8tgT7HjTQiSdlw) +2. [MCP 实践:基于 MCP 架构实现知识库答疑系统 - 阿里云开发者](https://mp.weixin.qq.com/s/ETmbEAE7lNligcM_A_GF8A) +3. [从零开始教你打造一个MCP客户端](https://mp.weixin.qq.com/s/zYgQEpdUC5C6WSpMXY8cxw) + +## 总结 + +MCP 协议的出现,标志着 AI 应用开发从"各自为战"走向"标准化协作"的时代。通过本文,我们系统梳理了 MCP 的核心知识: + +**核心要点回顾**: + +1. **MCP 是什么**:AI 领域的"USB-C 接口",通过 JSON-RPC 2.0 统一了 LLM 与外部工具的通信规范 +2. **四大核心能力**:Resources(只读数据)、Tools(可执行动作)、Prompts(预设指令)、Sampling(请求 LLM 推理) +3. **四层架构**:Host → Client → Server → Data Source,一对多连接,模型无感知 +4. **传输方式**:stdio(本地)、Streamable HTTP(远程),各有适用场景 +5. **生产级实践**:工具粒度设计、Context Window 管理、安全防护、失败路径处理 + +**与其他概念的区别**: + +- MCP vs Function Calling:MCP 是协议标准,Function Calling 是 LLM 能力 +- MCP vs Agent:MCP 是基础设施,Agent 是应用层系统 + +**学习建议**: + +1. **动手实践**:写一个简单的 MCP Server,理解 Host-Client-Server 的交互流程 +2. **阅读官方文档**:MCP 规范还在快速演进,保持对官方文档的关注 +3. **关注生态**:Awesome MCP Servers 收集了大量开源实现,是学习的好素材 + +MCP 为 AI 应用的规模化落地提供了标准化的基础设施,掌握它将让你在 AI 应用开发中如虎添翼。 diff --git a/docs/ai/agent/prompt-engineering.md b/docs/ai/agent/prompt-engineering.md new file mode 100644 index 00000000000..e69de29bb2d diff --git a/docs/ai/agent/skills.md b/docs/ai/agent/skills.md new file mode 100644 index 00000000000..fa00efb777c --- /dev/null +++ b/docs/ai/agent/skills.md @@ -0,0 +1,277 @@ +--- +title: 万字详解 Agent Skills:是什么?怎么用?和 Prompt、MCP 有什么区别? +description: 深入解析 Agent Skills 概念,探讨 Skills 与 Prompt、MCP、Function Calling 的本质区别,以及如何在实战中设计优秀的 Skill 固化代码规范。 +category: AI 应用开发 +icon: “skill” +head: + - - meta + - name: keywords + content: Agent Skills,MCP,Function Calling,Prompt,AI Agent,智能体,延迟加载,上下文注入 +--- + +2025 年初,Anthropic 在推出 **MCP(Model Context Protocol)** 之后,进一步提出了 **Agent Skills** 的概念。这不是技术倒退,而是对智能体架构的深度思考——**连接性(Connectivity)与能力(Capability)应该分离**。 + +很多开发者认为”只要提示词写得好,AI 就能帮我做一切”。但事实是:**Prompt 适合单次任务,Skills 才是构建可复用 AI 能力的正确方式**。 + +Skills 的出现,标志着 AI 应用从”玩具”走向”工具”、从”个人技巧”走向”工程化”的关键转折。今天 Guide 就带大家彻底搞懂这个概念,深入探讨 Skills 的设计理念、与相关技术的本质区别,以及如何在实战中用好这个能力。本文接近 1.2w 字,建议收藏,通过本文你将搞懂: + +1. ⭐ **Skills 是什么**:为什么说 Skill 是”延迟加载”的 sub-agent?它的核心机制——上下文注入和延迟加载是如何工作的? +2. ⭐ **Skills vs Prompt vs MCP vs Function Calling**:这四者的本质区别是什么?它们分别适用于什么场景?这是面试中的高频盲区。 +3. ⭐ **优秀的 Skill 长什么样**:一个设计良好的 Skill 应该包含哪些要素?元数据、触发条件、执行流程如何设计? +4. ⭐ **项目实战**:如何在真实开发中用 Skills 固化代码规范、排查流程、Review 标准?如何把团队中的”隐性知识”变成可复用的 AI 能力? + +## Skills 是什么? + +用一句话概括:**Skill 是一个用自然语言定义的、具有特定领域上下文(Domain Context)的逻辑指令集,本质上是通过延迟加载(Lazy Loading)优化 Token 消耗的 Sub-Agent(子智能体)**。 + +在团队协作中,很多"隐性知识"都在老员工脑子里,比如代码规范、排查流程、Review 标准。Skills 的核心价值,就是**把这些隐性规则变成显性的文档(SOP),让 AI 能够自主阅读、理解并执行**。 + +与传统编程不同,Skills 不强制规定每一步的代码逻辑,而是**用自然语言将决策权下放给模型**——模型通过 `load_skill()` 动态加载 `SKILL.md` 后,将其中定义的规则、流程和约束**实时注入到推理上下文**中,指导后续的工具调用和决策。这既保留了 Agent 处理不确定性的优势,又避免了纯代码编排的僵化。 + +> 为什么不用"基于 Function Calling 封装"?这个表述容易让人误以为 Skill 是某种 Function Calling 的语法糖。实际上,Skill 的核心机制是**上下文注入**——Agent 读取 Markdown 文档,把其中的规则和流程纳入推理上下文。Function Calling 只是 Agent 执行某些动作(如调脚本、查资源)时可能用到的底层手段,不是 Skills 本身的定义层。 +> +> 注意:`load_skill()` 是对"Agent 读取并激活 SKILL.md"这一过程的概念性描述,不同工具(Claude Code、Cursor 等)的实际触发方式会有差异。 + +**关键机制**: + +- **延迟加载(Lazy Loading)**:元数据保持简短(通常远少于正文)常驻上下文,正文仅在触发时动态注入,避免挤占 Token +- **动态上下文注入**:不同于静态文档的"阅读",Skills 是将规则实时注入推理上下文,直接影响模型决策 + +## Skills 和 Prompt、MCP、Function Calling有什么区别? + +这也是面试中常被问到的点,容易混淆: + +**1. Skills vs Prompt** + +| 维度 | Prompt | Skills | +| :----------- | :------------------------- | :----------------------------- | +| **本质** | 单次对话的文本指令 | 可持久化、可发现的**能力单元** | +| **复用性** | 随对话上下文丢失,难以维护 | 标准化封装,跨项目、多场景复用 | +| **加载机制** | 全量载入(挤占 Token) | **延迟加载**(按需读取正文) | + +- **Prompt**:用户即时表达意图的载体(如"分析这份报表")。 +- **Skills**:包含**元数据(何时使用)+ 正文(如何执行)**的完整方案,通过 `load_skill()` 机制按需加载到上下文。 + +**2. Skills vs MCP** + +这是最容易产生误解的地方。 + +| 维度 | MCP (Model Context Protocol) | Skills | +| :----------- | :----------------------------------------- | :--------------------------------------------- | +| **核心思路** | **标准化连接**:通过 JSON-RPC 统一数据格式 | **逻辑编排**:用自然语言描述复杂执行路径 | +| **定义方式** | 在 Server 端用代码(TS/Python)写死逻辑 | 在 `SKILL.md` 中用自然语言引导模型决策 | +| **环境依赖** | 需要运行一个 MCP Server 进程 | 依赖可执行环境(如本地 Shell 或沙箱) | +| **哲学** | **以协议为中心**:一次编写,所有 AI 通用 | **以模型为中心**:利用模型推理能力处理不确定性 | + +- **MCP 解决的是连通性** :它像 USB-C,让 AI 能以统一格式读文件、查数据库。 +- **Skills 解决的是编排逻辑** :它像一份说明书,告诉 AI 如何执行复杂任务流——这些任务完全可以包括调用多个 MCP 工具。 +- **两者的关系** :它们**不是竞争关系**,而是解决不同层面的问题。MCP 负责把外部系统接入进来,Skills 负责决定什么时候用、怎么组合这些能力。一个高级 Skill 的底层往往就是调用多个 MCP 工具。 + + + + + +**3. Function Calling vs Skills** + +| 维度 | Function Calling | Skills | +| :----------- | :----------------------- | :---------------------------------------------------------------------- | +| **层级** | 底层机制 | 上层应用 | +| **依赖关系** | 基础能力 | 在执行时**可能使用** Function Calling(如加载文档、执行脚本、读取资源) | +| **粒度** | 原子操作(单次工具调用) | 复合流程(多步骤决策 + 工具组合) | + +Skills **没有创造新能力**,而是通过自然语言文档将能力组织成更易用的形式: + +1. Agent 读取 `SKILL.md`,将规则和流程注入推理上下文。 +2. 根据上下文指导,Agent 可能通过 Function Calling 执行脚本、读取资源或调用 MCP 工具。 + +**系统总结**: + +| **组件** | **一句话定义** | **形象类比** | **关键理解** | +| :------------------- | :------------------------- | :----------- | :-------------------------------------------------- | +| **Prompt** | 即时意图表达的载体 | 用户说的话 | 单次、易失 | +| **Function Calling** | LLM 输出结构化调用的能力 | 神经信号 | **一切的基础**,实现非结构化→结构化转换 | +| **MCP** | 标准化的工具接入协议 | USB-C 接口 | 解决外部系统"如何接入"(连通性) | +| **Skills** | 用自然语言定义的 sub-agent | 任务说明书 | 解决复杂任务"如何编排"(执行逻辑),可调用 MCP 工具 | + +**四层关系**:Function Calling 是地基 → Prompt 表达意图 → MCP 负责连通外部系统 → Skills 负责编排复杂任务流(可调用 MCP) + +这里需要澄清一个常见误解:MCP 和 Skills **不是竞争关系**,也**不是非此即彼**。 + +- **MCP** 解决外部系统如何接入:让 AI 能以统一格式读文件、查数据库、调用 API。 +- **Skills** 解决复杂任务如何编排:用自然语言定义执行流程,这些流程完全可以包含调用多个 MCP 工具。 + +在实际项目中,两者经常配合使用:一个 Skill 的正文里会指导 Agent 先用 MCP 读取数据库,再用 MCP 调用外部 API,最后生成报告。 + +**一句话总结**:Prompt 承载意图,Function Calling 实现交互,MCP 负责连通外部系统,Skills 负责编排复杂任务流——从'说什么'到'怎么做'再到'聪明地做'。 + +## Skills 长什么样?你是怎么用的? + +从结构上看,Skill 很简单,核心就是一个 `SKILL.md` 文件,包含**元数据**(描述什么时候用)和**正文**(具体的执行 SOP)。 + +**设计上的亮点是“渐进式披露”**: + +- **元数据**常驻上下文,AI 知道有哪些技能可用。 +- **正文**按需加载,只有触发时才读取,避免挤占 Token。 + +复杂点的 Skill,还会有附加的资源目录、脚本和参考文档。 + +Skill 的完整目录结构是这样的: + +``` +skill-name/ +├── SKILL.md # 必需:元数据(何时使用)+ 正文(指令、流程、示例) +├── scripts/ # 可选:可执行脚本(Python/Bash),按需调用 +├── references/ # 可选:参考文档,按需读取 +└── assets/ # 可选:模板、图片等资源 +``` + +**项目实战**: + +我在项目中主要用 Skills 来**固化工程标准**。比如定义一个 `code-reviewer` Skill,明确要求从架构合理性、异常处理完整性、日志规范、安全风险、性能隐患等多个维度进行结构化审查。这样 AI 在 Review 代码时,就不再是“随缘点评”,而是严格执行团队标准。这对于保持代码质量的一致性非常有用。 + +除了 Code Review,我也会定义其他 Skill,例如: + +- `api-endpoint-generator` - 按项目统一响应结构与异常模型生成标准化接口代码 +- `database-access-review` - 审查数据库访问逻辑,关注索引使用与慢查询风险 +- `refactor-analysis` - 先评估影响范围与依赖关系,再输出分步骤重构方案 +- `security-audit` - 扫描 SQL 拼接、XSS、权限绕过等常见安全风险 + +**优秀 Skill 示例**: + +- Code-Review-Expert(专家代码审查 Skill,以资深工程师视角进行结构化代码审查,覆盖:架构设计、SOLID 原则、安全性、性能问题、错误处理、边界条件):**https://github.com/sanyuan0704/code-review-expert** +- Git Commit with Conventional Commits(一个基于 Conventional Commits 规范的智能提交工具,可自动分析 diff、智能暂存文件并生成语义化 commit message,安全高效完成标准化 Git 提交):**https://github.com/github/awesome-copilot/blob/main/skills/git-commit/SKILL.md** +- TDD(测试驱动开发,先编写测试用例,观察它是否失败,然后编写最少的代码使其通过测试):**https://github.com/obra/superpowers/blob/main/skills/test-driven-development/SKILL.md** + +**https://skills.sh/** 这个网站上可以查找自己需要和热门的 Skiils。 + + + +这里 Guide 多提一下,回答这个问题的时候,你也可以说自己团队用到了一些开源的软件开发 Skills 集合,例如 Superpowers 中内置的。 + + + +另外,很多 AI 编程 CLI 和 IDE 也会内置一些开箱即用的 Skills,例如 Claude Code 就内置了: + +| 技能 | 功能 | 特点 | +| ----------------- | ------------------------------------------------ | ----------------------------------------------------------- | +| **/simplify** | 审查最近修改的文件(复用、质量、效率),自动修复 | 并行多代理审查,适合功能/修复后清理 | +| **/batch <指令>** | 大规模批量修改代码库 | 自动任务拆分,每个任务在隔离 git worktree 中执行,可批量 PR | +| **/debug [描述]** | 排查当前 Claude Code 会话问题 | 读取 debug log | + +## 如何编写高质量的 AI Agent Skills? + +很多开发者第一次接触 Skills 时,会下意识地把它当成"文档"来写——堆砌背景介绍、安装指南、版本历史……结果发现 AI 要么"读不懂",要么"不用它"。 + +**编写高质量的 Skills 是一项专门的技能**,它不是在写给人看的 README,而是在**给 AI 写执行协议**。这个区别决定了你需要完全不同的思维方式: + +- **写给人**:注重可读性、完整性、背景知识 +- **写给 AI**:注重精准性、可执行性、上下文效率 + +接下来的内容将系统性地介绍如何编写高质量的 Skills。这些原则来自 Anthropic 官方文档和社区大规模生产实践,经过实战验证,能够让你的 Skills 在实际使用中发挥最大价值。 + +### 语义精确的 Metadata(元数据) + +Metadata 是 Agent 进行任务路由的核心依据,尤其是 description,它充当 LLM 的“索引”。 + +- **原则**:消除歧义,明确边界,并融入意图触发词。 +- **优化逻辑**:从“描述功能”转向“定义场景、问题和触发条件”。 + +| 维度 | 不好的示例 | 优化的示例 | 说明 | +| -------- | ------------ | -------------------------------------------------------------------------------------------------- | --------------------------------- | +| 描述 | 分析系统日志 | 诊断 Spring Boot 生产环境的运行时异常,包括解析 Java 堆栈跟踪、定位 OOM 内存溢出和分析慢接口耗时。 | 边界清晰,避免泛化。 | +| 触发意图 | 无明确引导 | 当用户提到“接口报错”、“系统卡死”、“频繁 Full GC”或粘贴错误日志时,立即激活此技能。 | 提供具体触发词,便于 Agent 匹配。 | + +在 Metadata 中添加 `parameters` 字段,定义输入输出格式(如 YAML),帮助 LLM 减少幻觉。例如: + +```yaml +parameters: + input: { type: string, description: "错误日志或堆栈跟踪" } + output: { type: json, description: "诊断结果,包括根因和建议" } +``` + +### 模块化与单一职责 + +大型“全能” Skills 会导致 LLM 在参数构建时产生幻觉。Agentic Workflow 更适合细粒度工具矩阵。 + +- **原则**:按排查维度拆分,确保每个 Skill 单一职责(SRP)。 +- **优化方案**:避免单一“系统故障排查器”,改为工具集: + - `jvm-metrics-analyzer`:专责通过 Prometheus 采集 JVM 指标(如堆内存、线程数)。 + - `distributed-trace-finder`:利用 SkyWalking 或 Zipkin 追踪特定 TraceId 的链路耗时。 + - `k8s-pod-event-viewer`:专责查询 Kubernetes Pod 状态变更和重启记录。 + +### 确定性优先原则 + +对于需要严谨逻辑的计算或格式转化,**永远不要相信 LLM 的“直觉”**,要让它去驱动脚本。 + +- **原则**:LLM 负责**提取参数**,脚本负责**逻辑闭环**。 +- **案例优化**: 当 Agent 发现 CPU 负载过高时,不要让它“盲猜”哪个线程有问题,而是让它调用一个封装好的诊断脚本。 + +**Skill 定义中的执行逻辑:** + +> “如果 CPU 使用率超过 80%,请提取节点 IP,调用 `./scripts/capture_thread_dump.sh`。不要尝试在对话框中手动模拟线程分析,直接解析脚本返回的 **Top 3 耗时线程堆栈**。” + +### 渐进式披露策略 + +避免”信息过载”导致 Agent 迷失。通过文档的分层结构,让 Agent 只在需要时加载细节。 + +**三层结构建议**: + +1. **SKILL.md(主体)**:定义核心故障类型(4xx, 5xx)和标准排查流转(SOP)。 +2. **`troubleshooting-guide.md`(附加)**:放置一些罕见的”陈年老坑”或特定中间件(如 RocketMQ)的配置盲区。 +3. **runbooks/(数据文件)**:存储历史故障知识库,由 Agent 通过 RAG 检索后再参考,而不是一股脑塞进上下文。 + +### 总结 + +编写高质量 Skills 的 **五大核心原则**: + +| **原则** | **核心思想** | **关键实践** | +| -------------- | ------------------------ | ----------------------------------------- | +| **语义精确** | 从”描述功能”到”定义场景” | 用祈使句 + 触发关键词 + 明确边界 | +| **极简主义** | 上下文是公共资源 | 删除噪音,10 行示例代替100行文字 | +| **模块化** | 单一职责避免幻觉 | 按排查维度拆解,而非建立”全能工具” | +| **确定性优先** | 识别”脆弱操作” | LLM 提取参数,脚本负责逻辑闭环 | +| **渐进式披露** | 按需加载,避免上下文爆炸 | L1 元数据常驻 + L2 正文按需 + L3 资源隔离 | + +**记住**:Skills 不是文档,而是**执行协议**。 + +## 总结与选型建议 + +### 核心观点 + +Skills 和 MCP 代表了智能体技术栈中两个关键的抽象层: + +| **组件** | **一句话定义** | **形象类比** | **关键理解** | +| ---------- | -------------------------- | ------------ | ---------------------------------- | +| **MCP** | 标准化的工具接入协议 | USB-C 接口 | 解决外部系统"如何接入"(连通性) | +| **Skills** | 用自然语言定义的 sub-agent | 任务说明书 | 解决复杂任务"如何编排"(执行逻辑) | + +**两者不是竞争关系,而是互补关系**: + +- MCP 专注于"能力"(提供基础设施连接) +- Skills 专注于"智慧"(提供业务逻辑和领域知识) + +### 实践建议 + +| 场景 | 推荐方案 | 原因 | +| -------------------------------------- | -------------------------------- | ---------------------- | +| 外部服务连接(数据库、API、云服务) | **优先使用 MCP** | 标准化接口,易于维护 | +| 复杂工作流(多步骤任务、领域专业知识) | **优先使用 Skills** | 封装领域知识,可复用 | +| 上下文受限场景(长对话、大量工具) | **使用 Skills 进行渐进式管理** | 降低 token 消耗 90%+ | +| 企业级智能体构建 | **采用 MCP + Skills 的分层架构** | 关注点分离,易维护扩展 | + +### 面试准备要点 + +**高频问题**: + +1. **Skills 是什么?** → 延迟加载的 sub-agent,解决"如何编排"问题 +2. **Skills 和 MCP 的区别?** → MCP 负责连通性,Skills 负责执行逻辑,互补关系 +3. **如何降低 token 消耗?** → 渐进式披露:元数据常驻,正文按需加载 +4. **什么是渐进式披露?** → 三层架构:元数据 → 正文 → 附加资源 +5. **如何编写高质量 Skills?** → 精准 description + 单一职责 + 确定性优先 + +**追问准备**: + +- 你的团队用了哪些 Skills?如何组织的? +- 如何评估一个 Skill 的好坏? +- Skills 如何与 MCP 配合使用? +- 如何避免 Skills 的上下文污染问题? diff --git a/docs/ai/ai-coding/cc-glm5.1.md b/docs/ai/ai-coding/cc-glm5.1.md new file mode 100644 index 00000000000..a9955aa2286 --- /dev/null +++ b/docs/ai/ai-coding/cc-glm5.1.md @@ -0,0 +1,456 @@ +--- +title: Claude Code 接入第三方模型实战:JVM 智能诊断与慢查询治理 +description: 通过 Claude Code 接入 GLM-5.1 模型,完成 JVM 智能诊断助手从零搭建和百万级数据量慢查询治理两个实战任务,分享 AI 辅助编程的工作方法与踩坑经验。 +category: AI 编程实战 +head: + - - meta + - name: keywords + content: Claude Code,AI编程,GLM-5.1,JVM诊断,慢查询优化,AI辅助开发,Arthas,Agent,Spring AI +--- + +大家好,我是 Guide。前面分享过 [IDEA 搭配 Qoder 插件的实战](./idea-qoder-plugin.md)和 [Trae 接入大模型的实战](./trae-m2.7.md),分别覆盖了 JetBrains 体系和 VS Code 体系下的 AI 辅助编码。这篇换个角度,聊聊 **Claude Code 接入第三方模型** 的实战体验。 + +Claude Code 本身是 Anthropic 官方的 CLI 编码工具,但它支持通过环境变量切换底层模型。这意味着你不必局限于 Claude 系列,完全可以接入其他模型来使用。本文以 GLM-5.1 作为示例,但接入方式是通用的——换成其他兼容模型,流程基本一致。 + +我选了两个比较有代表性的复杂场景来验证: + +- **场景一**:从零搭建一个基于 Arthas 的 JVM 智能诊断 Agent,涵盖技术选型、架构设计、编码落地的完整流程 +- **场景二**:在百万级数据量的既有订单系统中定位并治理慢查询,考验 AI 对现有代码库的理解和增量优化能力 + +一个是从零开始的工程交付,另一个是面对既有系统的性能治理,正好覆盖 AI 辅助编程的两种典型工作模式。 + +## 环境准备:Claude Code 接入第三方模型 + +在正式开始之前,需要完成 Claude Code 与第三方模型的对接。整个配置过程分三步: + +**第一步**:安装 Claude Code + +```bash +npm i -g @anthropic-ai/claude-code@latest +``` + +**第二步**:安装 cc-switch 完成模型切换(macOS 用户可通过 homebrew 安装,详情参考 cc-switch 官方文档:

PDF / Word / HTML / DB 记录"/] + DOC -->|加载 & 解析| SPLIT + SPLIT["✂️ 文本分割器

按语义/标题/长度切分"] + SPLIT -->|产生 chunks| CHUNKS + CHUNKS[/"📑 文档片段

带元数据的文本块"/] + end + + subgraph Vectorization["向量化 & 存储"] + direction TB + CHUNKS -->|批量嵌入| EMB + EMB["🧠 嵌入模型

文本 → 语义向量"] + EMB -->|生成 embeddings| VEC + VEC[/"🔢 向量表示

高维稠密向量"/] + VEC -->|持久化存储| DB + DB[("🗄️ 向量数据库

Milvus / pgvector / Faiss")] + end + end + + %% 颜色主题:文档阶段暖色 → 向量阶段冷色渐变 + style DOC fill:#F4D03F,stroke:#D35400,color:#333 + style SPLIT fill:#52B788,stroke:#2E8B57,color:#fff + style CHUNKS fill:#E67E22,stroke:#D35400,color:#fff + style EMB fill:#3498DB,stroke:#2980B9,color:#fff + style VEC fill:#2980B9,stroke:#1ABC9C,color:#fff + style DB fill:#2C3E50,stroke:#1A252F,color:#fff + + %% 子图美化 + style PreProcess fill:#FFF3E0,stroke:#FFCC80,stroke-dasharray: 5 5 + style Vectorization fill:#E3F2FD,stroke:#90CAF9,stroke-dasharray: 5 5 + style Indexing fill:#F5F5F5,stroke:#BDBDBD,rx:20,ry:20 +``` + +检索通常在线进行的,当用户提交一个问题时,系统会使用已索引的文档来回答问题。该阶段通常包括以下步骤: + +1. **接收请求:** 接收用户的自然语言查询(Query),例如一个问题或任务描述。在某些进阶场景中,系统会先对原始查询进行改写或扩充,以提高后续检索的覆盖率。 +2. **查询向量化:** 使用嵌入模型(Embedding Model)将用户查询转换为语义向量表示(Query Embedding,也就是高维稠密向量),以捕捉查询的语义信息。 +3. **信息检索 (R):** 在嵌入存储(Embedding Store)中,通过语义相似性搜索找到与查询向量最相关的文档片段(Relevant Segments)。 +4. **生成增强 (A):** 将检索到的相关片段和原始查询作为上下文输入给 LLM,并使用合适的提示词引导 LLM 基于检索到的信息回答问题。 +5. **输出生成 (G):** 向用户输出自然语言回复,并附带相关的参考资料链接。 +6. **结果反馈(可选):** 如果用户对生成的结果不满意,可以允许用户提供反馈,通过调整提示词或检索方式优化生成效果。在某些实现中,支持多轮交互,进一步完善回答。 + +**检索阶段的简化流程图如下**: + +```mermaid +flowchart TB + subgraph Retrieval["🔍 检索阶段(在线推理)"] + direction TB + + subgraph QueryVectorization["查询向量化"] + direction LR + Q[/"💬 用户查询

自然语言问题或指令"/] + Q -->|语义编码| EMB2 + EMB2["🧠 嵌入模型

Query → 语义向量(同文档模型)"] + EMB2 -->|生成查询向量| QV + QV[/"🔢 查询向量

高维稠密向量"/] + end + + subgraph RetrieveAndGenerate["检索 & 生成"] + direction TB + QV -->|相似度搜索| DB2 + DB2[("🗄️ 向量数据库

Top-K 近似最近邻检索")] + DB2 -->|返回相关块| REL + REL[/"📑 相关片段

Top-K 最相似文档块"/] + REL -->|合并证据| CTX + Q -->|原始查询| CTX + CTX["🔗 上下文构建

Query + 相关片段(带元数据)"] + CTX -->|提示工程| LLM + LLM["🤖 大语言模型

生成式推理(带引用)"] + LLM -->|输出最终答案| ANS + ANS[/"✅ 生成答案

自然语言回复 + 来源引用"/] + end + end + + %% 颜色主题:查询暖色 → 向量/检索冷色 → 生成回归暖色 + style Q fill:#F4D03F,stroke:#D35400,color:#333 + style EMB2 fill:#52B788,stroke:#2E8B57,color:#fff + style QV fill:#E67E22,stroke:#D35400,color:#fff + style DB2 fill:#2C3E50,stroke:#1A252F,color:#fff + style REL fill:#E67E22,stroke:#D35400,color:#fff + style CTX fill:#3498DB,stroke:#2980B9,color:#fff + style LLM fill:#52B788,stroke:#2E8B57,color:#fff + style ANS fill:#F4D03F,stroke:#D35400,color:#333 + + %% 子图美化(与上一张保持一致) + style QueryVectorization fill:#FFF3E0,stroke:#FFCC80,stroke-dasharray: 5 5 + style RetrieveAndGenerate fill:#E3F2FD,stroke:#90CAF9,stroke-dasharray: 5 5 + style Retrieval fill:#F5F5F5,stroke:#BDBDBD,rx:20,ry:20 +``` + +## RAG 与传统搜索引擎的区别是什么? + + + +RAG 与传统搜索引擎虽然都涉及信息获取,但它们在**检索机制、信息处理和交付形式**上有本质区别: + +1. **检索机制:** + - **传统搜索**主要依赖**倒排索引与词汇匹配**(如 BM25、TF-IDF),对关键词的字面形式依赖强。虽然现代搜索引擎也引入了语义理解(如 BERT),但核心仍是基于词汇统计的相关性计算。 + - **RAG** 通常采用**向量语义搜索**,能够识别同义词和深层语境,解决语义鸿沟问题。 +2. **处理逻辑:** + - **传统搜索**本质是**相关性排序器**,将候选文档按相关性得分排序后直接呈现给用户。每个结果相对独立,不进行跨文档的信息融合。 + - **RAG** 的本质是 **信息综合器**,它会将检索到的多个知识碎片(Chunks)喂给 LLM,由模型进行逻辑归纳和跨文档的信息整合。 +3. **结果交付:** + - **传统搜索**提供候选文档列表(线索),需要用户二次阅读过滤; + - **RAG** 提供的是答案,能直接回答复杂指令,并通过引文标注(Citations)兼顾了信息的来源可追溯性。 +4. **时效性与数据范围:** 传统搜索更依赖大规模爬虫和全网索引;RAG 则常用于**私有知识库或垂直领域**,能低成本地让 LLM 获得实时或特定领域的知识补充,无需频繁微调模型。 + +## ⭐️ RAG 的核心优势和局限性分别是什么? + +RAG 的核心优势和局限性可以从**知识管理、工程落地和性能指标**三个维度来分析: + +**核心优势:** + +1. **知识时效性与低维护成本:** 相比微调,RAG 无需重新训练模型。只需更新向量数据库或知识库,模型就能立即获取最新信息,非常适合处理新闻、法规、产品文档等频繁变动的数据。这种即插即用的特性使得知识更新的成本从数千美元降低到几乎为零。 +2. **显著降低幻觉并提供引文追溯:** RAG 将模型从“基于参数化记忆生成”转变为“基于检索证据生成”。每个回答都有明确的信息来源,提供了关键的**可解释性和可验证性**。这对金融合规、医疗诊断、法律咨询等对准确性要求极高的场景至关重要。 +3. **数据安全与细粒度权限控制:** 可以在检索层实现精准的**多租户隔离和访问控制(ACL)**,确保用户只能检索其权限范围内的数据。相比将敏感数据通过微调“烧入”模型参数(存在数据泄露风险),RAG 的架构天然支持数据隔离和合规要求。 +4. **领域适应性强:** 无需针对特定领域重新训练模型,只需构建领域知识库即可快速适配垂直场景,如企业内部知识管理、专业技术支持等。 + +**局限性与工程挑战:** + +1. **严重的检索依赖性:** 遵循 GIGO(Garbage In, Garbage Out)原则。如果输入的信息质量不好,即便下游模型再强,也很难输出正确的结果。这个在 RAG 系统里体现得尤为明显。比如说,如果检索阶段的 embedding 表达不准确,或者分块策略不合理,导致召回的内容跟问题无关,那无论上下游用什么大模型,最终生成的答案也不会靠谱。 +2. **上下文窗口与推理噪声:** 虽然 Context Window 已经卷到了百万级(如 Claude 4.6 Opus 的 1M 上限),但这并不意味着我们可以“暴力喂养”。注入过多无关片段(Noisy Chunks)会造成**注意力稀释**,干扰模型的逻辑推理,且带来**不必要的 Token 开销**。 +3. **首字延迟(TTFT)增加:** 完整链路包括“查询改写 -> 向量化 -> 相似度检索 -> 重排序(Rerank)-> 上下文构建 -> LLM 生成”,每个环节都增加延迟。 +4. **工程复杂度:** 需要维护向量数据库、处理文档更新的增量索引、优化检索策略等,相比纯 LLM 应用复杂度大幅提升。 +5. **长文本 Token 成本:** 虽然省去了训练费,但单次请求携带大量上下文会导致推理成本(Input Tokens)显著高于普通对话。 + +## ⭐️ 更多 RAG 高频面试题 + +上面的内容摘自我的[星球](https://javaguide.cn/about-the-author/zhishixingqiu-two-years.html)实战项目教程: [《SpringAI 智能面试平台+RAG 知识库》](https://javaguide.cn/zhuanlan/interview-guide.html)。内容安排如下(已经更完,一共 13w+ 字) + + + +Spring AI 和 RAG 面试题两篇加起来就接近 60 道题目,主打一个全面! + + + +**项目地址** (欢迎 Star 鼓励): + +- Github:

diff --git a/docs/books/cs-basics.md b/docs/books/cs-basics.md

index e67ac115964..9e7a76c8674 100644

--- a/docs/books/cs-basics.md

+++ b/docs/books/cs-basics.md

@@ -1,5 +1,6 @@

---

title: 计算机基础必读经典书籍

+description: 计算机基础书籍推荐,操作系统、计算机网络、算法与数据结构、编译原理等核心课程经典教材和学习资源汇总。

category: 计算机书籍

icon: "computer"

head:

diff --git a/docs/books/database.md b/docs/books/database.md

index 87f92d24184..cfdbcac5adf 100644

--- a/docs/books/database.md

+++ b/docs/books/database.md

@@ -1,5 +1,6 @@

---

title: 数据库必读经典书籍

+description: 数据库书籍推荐,MySQL、PostgreSQL、Redis等数据库经典书籍,涵盖入门教程、原理剖析、性能优化等内容。

category: 计算机书籍

icon: "database"

head:

diff --git a/docs/books/distributed-system.md b/docs/books/distributed-system.md

index bb131d6dd65..89c15045e1e 100644

--- a/docs/books/distributed-system.md

+++ b/docs/books/distributed-system.md

@@ -1,5 +1,6 @@

---

title: 分布式必读经典书籍

+description: 分布式系统书籍推荐,DDIA、分布式事务、共识算法、微服务架构等经典书籍,掌握分布式系统设计核心知识。

category: 计算机书籍

icon: "distributed-network"

---

diff --git a/docs/books/java.md b/docs/books/java.md

index b93e77f2e83..be9f36197a0 100644

--- a/docs/books/java.md

+++ b/docs/books/java.md

@@ -1,5 +1,6 @@

---

title: Java 必读经典书籍

+description: Java程序员必读书籍推荐,Java基础、并发编程、JVM虚拟机、Spring/SpringBoot框架、Netty网络编程、性能调优等经典书籍精选。

category: 计算机书籍

icon: "java"

---

diff --git a/docs/books/search-engine.md b/docs/books/search-engine.md

index 50abbd57056..bf5ac35a82f 100644

--- a/docs/books/search-engine.md

+++ b/docs/books/search-engine.md

@@ -1,5 +1,6 @@

---

title: 搜索引擎必读经典书籍

+description: 搜索引擎书籍推荐,Lucene入门、Elasticsearch核心技术与实战、源码解析与优化实战等经典书籍精选。

category: 计算机书籍

icon: "search"

---

diff --git a/docs/books/software-quality.md b/docs/books/software-quality.md

index 5cfce79dfaa..5dccbb4afd1 100644

--- a/docs/books/software-quality.md

+++ b/docs/books/software-quality.md

@@ -1,5 +1,6 @@

---

title: 软件质量必读经典书籍

+description: 软件质量与代码整洁书籍推荐,重构、Clean Code、Effective Java、架构整洁之道等经典书籍,提升代码质量和架构设计能力。

category: 计算机书籍

icon: "highavailable"

head:

diff --git a/docs/cs-basics/algorithms/10-classical-sorting-algorithms.md b/docs/cs-basics/algorithms/10-classical-sorting-algorithms.md

index a55f179aa92..aa116d0d752 100644

--- a/docs/cs-basics/algorithms/10-classical-sorting-algorithms.md

+++ b/docs/cs-basics/algorithms/10-classical-sorting-algorithms.md

@@ -1,5 +1,6 @@

---

title: 十大经典排序算法总结

+description: 系统梳理十大经典排序算法,附复杂度与稳定性对比,覆盖比较类与非比较类排序的核心原理与实现场景,帮助快速选型与优化。

category: 计算机基础

tag:

- 算法

@@ -7,9 +8,6 @@ head:

- - meta

- name: keywords

content: 排序算法,快速排序,归并排序,堆排序,冒泡排序,选择排序,插入排序,希尔排序,桶排序,计数排序,基数排序,时间复杂度,空间复杂度,稳定性

- - - meta

- - name: description

- content: 系统梳理十大经典排序算法,附复杂度与稳定性对比,覆盖比较类与非比较类排序的核心原理与实现场景,帮助快速选型与优化。

---

> 本文转自:

diff --git a/docs/books/cs-basics.md b/docs/books/cs-basics.md

index e67ac115964..9e7a76c8674 100644

--- a/docs/books/cs-basics.md

+++ b/docs/books/cs-basics.md

@@ -1,5 +1,6 @@

---

title: 计算机基础必读经典书籍

+description: 计算机基础书籍推荐,操作系统、计算机网络、算法与数据结构、编译原理等核心课程经典教材和学习资源汇总。

category: 计算机书籍

icon: "computer"

head:

diff --git a/docs/books/database.md b/docs/books/database.md

index 87f92d24184..cfdbcac5adf 100644

--- a/docs/books/database.md

+++ b/docs/books/database.md

@@ -1,5 +1,6 @@

---

title: 数据库必读经典书籍

+description: 数据库书籍推荐,MySQL、PostgreSQL、Redis等数据库经典书籍,涵盖入门教程、原理剖析、性能优化等内容。

category: 计算机书籍

icon: "database"

head:

diff --git a/docs/books/distributed-system.md b/docs/books/distributed-system.md

index bb131d6dd65..89c15045e1e 100644

--- a/docs/books/distributed-system.md

+++ b/docs/books/distributed-system.md

@@ -1,5 +1,6 @@

---

title: 分布式必读经典书籍

+description: 分布式系统书籍推荐,DDIA、分布式事务、共识算法、微服务架构等经典书籍,掌握分布式系统设计核心知识。

category: 计算机书籍

icon: "distributed-network"

---

diff --git a/docs/books/java.md b/docs/books/java.md

index b93e77f2e83..be9f36197a0 100644

--- a/docs/books/java.md

+++ b/docs/books/java.md

@@ -1,5 +1,6 @@

---

title: Java 必读经典书籍

+description: Java程序员必读书籍推荐,Java基础、并发编程、JVM虚拟机、Spring/SpringBoot框架、Netty网络编程、性能调优等经典书籍精选。

category: 计算机书籍

icon: "java"

---

diff --git a/docs/books/search-engine.md b/docs/books/search-engine.md

index 50abbd57056..bf5ac35a82f 100644

--- a/docs/books/search-engine.md

+++ b/docs/books/search-engine.md

@@ -1,5 +1,6 @@

---

title: 搜索引擎必读经典书籍

+description: 搜索引擎书籍推荐,Lucene入门、Elasticsearch核心技术与实战、源码解析与优化实战等经典书籍精选。

category: 计算机书籍

icon: "search"

---

diff --git a/docs/books/software-quality.md b/docs/books/software-quality.md

index 5cfce79dfaa..5dccbb4afd1 100644

--- a/docs/books/software-quality.md

+++ b/docs/books/software-quality.md

@@ -1,5 +1,6 @@

---

title: 软件质量必读经典书籍

+description: 软件质量与代码整洁书籍推荐,重构、Clean Code、Effective Java、架构整洁之道等经典书籍,提升代码质量和架构设计能力。

category: 计算机书籍

icon: "highavailable"

head:

diff --git a/docs/cs-basics/algorithms/10-classical-sorting-algorithms.md b/docs/cs-basics/algorithms/10-classical-sorting-algorithms.md

index a55f179aa92..aa116d0d752 100644

--- a/docs/cs-basics/algorithms/10-classical-sorting-algorithms.md

+++ b/docs/cs-basics/algorithms/10-classical-sorting-algorithms.md

@@ -1,5 +1,6 @@

---

title: 十大经典排序算法总结

+description: 系统梳理十大经典排序算法,附复杂度与稳定性对比,覆盖比较类与非比较类排序的核心原理与实现场景,帮助快速选型与优化。

category: 计算机基础

tag:

- 算法

@@ -7,9 +8,6 @@ head:

- - meta

- name: keywords

content: 排序算法,快速排序,归并排序,堆排序,冒泡排序,选择排序,插入排序,希尔排序,桶排序,计数排序,基数排序,时间复杂度,空间复杂度,稳定性

- - - meta

- - name: description

- content: 系统梳理十大经典排序算法,附复杂度与稳定性对比,覆盖比较类与非比较类排序的核心原理与实现场景,帮助快速选型与优化。

---

> 本文转自:连接状态 SYN_RCVD

放入 SYN queue + + C->>K: ACK 第三次握手 + Note over SQ,AQ: 内核收到 ACK 后完成握手

将连接从 SYN queue 迁移到 Accept queue

队列未满才可进入 + Note over AQ: 连接已完成 可被 accept

连接状态 ESTABLISHED + + App->>K: accept + K-->>App: 返回已就绪的 socket + Note over AQ: 该连接从 Accept queue 移除 +``` + +在 TCP 三次握手过程中,服务端内核通常会用两个队列来管理连接请求(不同操作系统/内核版本实现细节可能略有差异,下面以常见 Linux 行为为例): + +1. **半连接队列**(也称 SYN Queue): + - 保存“握手未完成”的请求:服务端收到 SYN 并回 SYN+ACK 后,连接进入 SYN_RCVD,等待客户端最终 ACK。 + - 如果一直收不到 ACK,内核会按重传策略重发 SYN+ACK,最终超时清理。 + - 常见相关参数:`net.ipv4.tcp_max_syn_backlog`;在 SYN Flood 场景下可配合 `net.ipv4.tcp_syncookies`。 +2. **全连接队列**(也称 Accept Queue): + - 保存“握手已完成但应用还没 accept”的连接:服务端收到最终 ACK 后连接变为 `ESTABLISHED`,并进入 全连接队列,等待应用层 `accept()` 取走。 + - 队列容量受 `listen(fd, backlog)` 与系统上限 `net.core.somaxconn` 共同影响;实践中常见有效上限近似为 `min(backlog, somaxconn)`(具体行为与内核版本相关)。 + +总结: + +| 队列 | 作用 | 状态 | 移出条件 | +| -------------------------- | ------------------ | ----------- | ----------------------- | +| 半连接队列(SYN Queue) | 保存未完成握手连接 | SYN_RCVD | 收到 ACK / 超时重传失败 | +| 全连接队列(Accept Queue) | 保存已完成握手连接 | ESTABLISHED | 被应用层 accept() 取出 | -1. **半连接队列**(也称 SYN Queue):当服务端收到客户端的 SYN 请求并回复 SYN+ACK 后,连接会处于 SYN_RECV 状态。此时,这个连接信息会被放入半连接队列。这个队列存储的是尚未完成三次握手的连接。 -2. **全连接队列**(也称 Accept Queue):当服务端收到客户端对 ACK 响应时,意味着三次握手成功完成,服务端会将该连接从半连接队列移动到全连接队列。如果未收到客户端的 ACK 响应,会进行重传,重传的等待时间通常是指数增长的。如果重传次数超过系统规定的最大重传次数,系统将从半连接队列中删除该连接信息。 +当全连接队列满时,`net.ipv4.tcp_abort_on_overflow` 会影响处理策略: -这两个队列的存在是为了处理并发连接请求,确保服务端能够有效地管理新的连接请求。 +- `0`(默认):通常不会立刻让连接快速失败,给应用留缓冲时间(可能表现为客户端重试/超时)。 +- `1`:直接对客户端回复 `RST`,让连接快速失败。 -如果全连接队列满了,新的已完成握手的连接可能会被丢弃,或者触发其他策略。这两个队列的大小都受系统参数控制,它们的容量限制是影响服务器处理高并发连接能力的重要因素,也是 SYN 泛洪攻击(SYN Flood)所针对的目标。 +当半连接队列满时,如果开启了 `tcp_syncookies`,服务端可能不会为该连接在半连接队列中分配常规条目,而是计算并返回一个 **SYN Cookie**。只有当收到合法的最终 `ACK` 时,才“重建”必要的连接信息。这是抵御 **SYN Flood** 的核心手段之一。 ### 为什么要三次握手? @@ -46,23 +83,70 @@ TCP 三次握手的核心目的是为了在客户端和服务器之间建立一 **1. 确认双方的收发能力,并同步初始序列号 (ISN)** -TCP 通信依赖序列号来保证数据的有序和可靠。三次握手是双方交换和确认彼此初始序列号(ISN)的过程,通过这个过程,双方也间接验证了各自的收发能力。 +```mermaid +sequenceDiagram + autonumber + participant C as 客户端 Client + participant S as 服务端 Server -- **第一次握手 (客户端 → 服务器)** :客户端发送 SYN 包。 - - 服务器:能确认客户端的发送能力正常,自己的接收能力正常。 - - 客户端:无法确认任何事。 -- **第二次握手 (服务器 → 客户端)** :服务器回复 SYN+ACK 包。 - - 客户端:能确认自己的发送和接收能力正常,服务器的接收和发送能力正常。 - - 服务端:能确认对方发送能力正常,自己接收能力正常 -- **第三次握手 (客户端 → 服务器)** :客户端发送 ACK 包。 - - 客户端:能确认双方发送和接收能力正常。 - - 服务端:能确认双方发送和接收能力正常。 + Note over C,S: 目标 同步双方 ISN 并确认双向可达 + + C->>S: SYN seq=ISN_C + Note right of S: 服务端确认 客户端到服务端方向可达 + Note right of S: 服务端状态 SYN_RCVD + + S->>C: SYN 加 ACK seq=ISN_S ack=ISN_C+1 + Note left of C: 客户端确认

1 服务端到客户端方向可达

2 服务端已收到客户端 SYN

3 获得 ISN_S + + C->>S: ACK seq=ISN_C+1 ack=ISN_S+1 + Note left of C: 客户端状态 ESTABLISHED + Note right of S: 服务端确认 客户端已收到 SYN 加 ACK

双方 ISN 同步完成 + Note right of S: 服务端状态 ESTABLISHED + + Note over C,S: 连接建立 可以开始传输数据 +``` + +TCP 依赖序列号(SEQ)与确认号(ACK)保证数据**有序、无重复、可重传**。三次握手通过交换并确认双方的 ISN,使两端对“从哪一个序号开始收发数据”达成一致,同时让握手过程形成闭环,避免仅凭单向信息就进入已建立状态。 经过这三次交互,双方都确认了彼此的收发功能完好,并完成了初始序列号的同步,为后续可靠的数据传输奠定了基础。 +三次握手能力确认速记: + +1. C→S:SYN → S 确认:C 能发,S 能收(C→S 通)。 +2. S→C:SYN+ACK → C 确认:S 能发,C 能收,且 S 已收到 C 的 SYN(对方 SEQ + 1)。 +3. C→S:ACK → S 确认:C 已收到 S 的 SYN+ACK,握手闭环,连接建立。 + **2. 防止已失效的连接请求被错误地建立** -这是“为什么不能是两次握手”的关键原因。 +```mermaid +sequenceDiagram + participant C as 客户端 (Client) + participant S as 服务端 (Server) + + Note over C,S: 场景:旧的 SYN 报文在网络中滞留 + + C->>S: 1. 发送 SYN (旧请求 - 滞留中) + Note over C: 客户端超时,放弃该请求 + + C->>S: 2. 发送 SYN (新请求) + S-->>C: 3. 建立连接并正常释放... + + rect rgb(255, 240, 240) + Note right of S: 此时,旧的 SYN 终于到达服务端 + S->>C: 4. 发送 SYN+ACK (针对旧请求) + + alt 如果是【两次握手】 + Note right of S: (假设服务端在回复 SYN+ACK 后即认为连接建立) + Note right of S: ❌ 错误建立连接 (Ghost Connection)

分配内存/资源,造成浪费 + else 如果是【三次握手】 + Note left of C: 客户端无该连接状态 / 非期望报文 + C->>S: 5. 发送 RST (重置报文) 或 直接丢弃 + + Note right of S: 【服务端结果】

收到 RST 立即清理;

或未收到 ACK 则重传并最终超时清理 + Note right of S: ✅ 避免错误建连,保护资源 + end + end +``` 设想一个场景:客户端发送的第一个连接请求(SYN1)因网络延迟而滞留,于是客户端重发了第二个请求(SYN2)并成功建立了连接,数据传输完毕后连接被释放。此时,延迟的 SYN1 才到达服务端。 @@ -73,7 +157,9 @@ TCP 通信依赖序列号来保证数据的有序和可靠。三次握手是双 ### 第 2 次握手传回了 ACK,为什么还要传回 SYN? -服务端传回发送端所发送的 ACK 是为了告诉客户端:“我接收到的信息确实就是你所发送的信号了”,这表明从客户端到服务端的通信是正常的。回传 SYN 则是为了建立并确认从服务端到客户端的通信。 +第二次握手里的 ACK 是为了确认“服务端确实收到了客户端的 SYN”(即确认 C→S 的请求到达)。而同时携带 SYN 是为了把服务端自己的 ISN 也同步给客户端,并要求客户端对其进行确认(即建立并确认 S→C 方向的建立过程)。只有双方的 ISN 都同步完成,后续的可靠传输(按序、重传、去重)才有共同起点。 + +简言之:ACK 用于“我收到了你的 SYN”,SYN 用于“我也要发起我的同步,请你确认”。 > SYN 同步序列编号(Synchronize Sequence Numbers) 是 TCP/IP 建立连接时使用的握手信号。在客户机和服务端之间建立正常的 TCP 网络连接时,客户机首先发出一个 SYN 消息,服务端使用 SYN-ACK 应答表示接收到了这个消息,最后客户机再以 ACK(Acknowledgement)消息响应。这样在客户机和服务端之间才能建立起可靠的 TCP 连接,数据才可以在客户机和服务端之间传递。 @@ -94,26 +180,60 @@ TCP 通信依赖序列号来保证数据的有序和可靠。三次握手是双 3. **第三次挥手 (FIN)**:当服务端确认所有待发送的数据都已发送完毕后,它也会向客户端发送一个 **FIN** 报文段,表示自己也准备关闭连接。该报文段同样包含一个序列号 seq=y。发送后,服务端进入 **LAST-ACK** 状态,等待客户端的最终确认。 4. **第四次挥手**:客户端收到服务端的 FIN 报文段后,会回复一个最终的 **ACK** 确认报文段,确认号为 ack=y+1。发送后,客户端进入 **TIME-WAIT** 状态。服务端在收到这个 ACK 后,立即进入 **CLOSED** 状态,完成连接关闭。客户端则会在 **TIME-WAIT** 状态下等待 **2MSL**(Maximum Segment Lifetime,报文段最大生存时间)后,才最终进入 **CLOSED** 状态。 -**只要四次挥手没有结束,客户端和服务端就可以继续传输数据!** +四次挥手期间连接可能处于**半关闭(Half-Close)**:**先发送 FIN 的一方不再发送应用数据**,但**另一方仍可继续发送剩余数据**,直到它也发送 FIN 并完成后续 ACK。 ### 为什么要四次挥手? -TCP 是全双工通信,可以双向传输数据。任何一方都可以在数据传送结束后发出连接释放的通知,待对方确认后进入半关闭状态。当另一方也没有数据再发送的时候,则发出连接释放通知,对方确认后就完全关闭了 TCP 连接。 +TCP 是全双工通信:两端的发送方向彼此独立。断开连接时,往往需要“我不发了”与“你也不发了”分别被对方确认,因此通常表现为四个报文段(FIN/ACK/FIN/ACK)。这也对应了现实世界的“双方分别确认挂断”的过程。 举个例子:A 和 B 打电话,通话即将结束后。 -1. **第一次挥手**:A 说“我没啥要说的了” -2. **第二次挥手**:B 回答“我知道了”,但是 B 可能还会有要说的话,A 不能要求 B 跟着自己的节奏结束通话 -3. **第三次挥手**:于是 B 可能又巴拉巴拉说了一通,最后 B 说“我说完了” -4. **第四次挥手**:A 回答“知道了”,这样通话才算结束。 +1. **第一次挥手**:A 说“我没啥要说的了”(A 发 FIN) +2. **第二次挥手**:B 回答“我知道了”,但是 B 可能还会有要说的话,A 不能要求 B 跟着自己的节奏结束通话(B 回 ACK,但可能还有话要说) +3. **第三次挥手**:于是 B 可能又巴拉巴拉说了一通,最后 B 说“我说完了”(B 发 FIN) +4. **第四次挥手**:A 回答“知道了”,这样通话才算结束(A 回 ACK)。 ### 为什么不能把服务端发送的 ACK 和 FIN 合并起来,变成三次挥手? -因为服务端收到客户端断开连接的请求时,可能还有一些数据没有发完,这时先回复 ACK,表示接收到了断开连接的请求。等到数据发完之后再发 FIN,断开服务端到客户端的数据传送。 +```mermaid +sequenceDiagram + autonumber + participant C as 客户端 + participant K as 服务端内核 + participant A as 服务端应用 + + Note over C,K: 客户端发起关闭 + C->>K: FIN + Note right of K: 内核立即回复 ACK 用于确认对端 FIN + K-->>C: ACK + Note right of K: 服务端状态变为 CLOSE_WAIT + + Note over K,A: 应用处理阶段 + K->>A: 通知本端应用对端已关闭发送方向 例如 read 返回 0 + A->>A: 读取和处理剩余数据 + A->>A: 发送最后响应 + A->>K: 调用 close 或 shutdown + + Note right of K: 发送本端 FIN 并进入 LAST_ACK + K-->>C: FIN + Note left of C: 客户端回复 ACK 并进入 TIME_WAIT + C->>K: ACK + Note right of K: 服务端收到最终 ACK 后进入 CLOSED + + +``` + +关键原因是:**回复 ACK** 与 **发送 FIN** 的触发时机往往不同步。 + +- 当服务端收到客户端 FIN 时,内核协议栈会立即回 ACK,用于确认“我收到了你要关闭的请求”。此时服务端进入 CLOSE_WAIT,等待本端应用把剩余事情处理完。 +- 只有当服务端应用处理完毕并调用 `close()/shutdown()` 后,内核才会发送本端的 FIN。 +- 因此“内核自动回 ACK”和“应用决定发 FIN”在时间上是解耦的,通常无法合并。只有在服务端恰好也准备立即关闭时,才可能出现 FIN+ACK 合并在一个报文段中的情况。 ### 如果第二次挥手时服务端的 ACK 没有送达客户端,会怎样? -客户端在发送 FIN 后会启动一个重传计时器。如果在计时器超时之前没有收到服务端的 ACK,客户端会认为 FIN 报文丢失,并重新发送 FIN 报文。 +- **客户端状态**:客户端发送第一次 `FIN` 后进入 **FIN_WAIT_1** 并启动重传计时器。 +- **重传逻辑**:若在超时时间内未收到对端对该 `FIN` 的确认 `ACK`,客户端会重传 `FIN`。 +- **服务端处理**:服务端若收到重复 `FIN`,通常会再次发送 `ACK`。如果由于网络问题 ACK 一直到不了,客户端在达到一定重试/超时阈值后可能报错或放弃(具体由实现与参数如 `tcp_retries2` 等影响)。 ### 为什么第四次挥手客户端需要等待 2\*MSL(报文段最长寿命)时间后才进入 CLOSED 状态? @@ -124,11 +244,8 @@ TCP 是全双工通信,可以双向传输数据。任何一方都可以在数 ## 参考 - 《计算机网络(第 7 版)》 - - 《图解 HTTP》 - - TCP and UDP Tutorial:

数据库管理系统"] + + subgraph define["数据定义"] + DDL["📐 DDL

Data Definition Language"] + DDL_Items["• 创建/修改/删除对象

• 定义表结构

• 定义视图、索引

• 定义触发器

• 定义存储过程"] + end + + subgraph operate["数据操作"] + DML["⚡ DML

Data Manipulation Language"] + CRUD["CRUD 操作

• Create 创建

• Read 读取

• Update 更新

• Delete 删除"] + end + + subgraph control["数据控制"] + DCL["🔐 数据控制功能"] + Control_Items["• 并发控制

• 事务管理

• 完整性约束

• 权限控制

• 安全性限制"] + end + + subgraph maintain["数据库维护"] + Maintenance["🛠️ 维护功能"] + Maintain_Items["• 数据导入/导出

• 备份与恢复

• 性能监控与分析

• 系统日志管理"] + end + + DBMS --> DDL + DBMS --> DML + DBMS --> DCL + DBMS --> Maintenance + + DDL --> DDL_Items + DML --> CRUD + DCL --> Control_Items + Maintenance --> Maintain_Items + + style DBMS fill:#005D7B,stroke:#00838F,stroke-width:4px,color:#fff + + style DDL fill:#4CA497,stroke:#00838F,stroke-width:3px,color:#fff + style DDL_Items fill:#f0fffe,stroke:#4CA497,stroke-width:2px,color:#333 + + style DML fill:#E99151,stroke:#C44545,stroke-width:3px,color:#fff + style CRUD fill:#fff5e6,stroke:#E99151,stroke-width:2px,color:#333 + + style DCL fill:#00838F,stroke:#005D7B,stroke-width:3px,color:#fff + style Control_Items fill:#e6f7ff,stroke:#00838F,stroke-width:2px,color:#333 + + style Maintenance fill:#C44545,stroke:#8B0000,stroke-width:3px,color:#fff + style Maintain_Items fill:#ffe6e6,stroke:#C44545,stroke-width:2px,color:#333 + + style define fill:#E4C189,stroke:#E99151,stroke-width:2px,stroke-dasharray: 5 5,opacity:0.3 + style operate fill:#E4C189,stroke:#E99151,stroke-width:2px,stroke-dasharray: 5 5,opacity:0.3 + style control fill:#E4C189,stroke:#E99151,stroke-width:2px,stroke-dasharray: 5 5,opacity:0.3 + style maintain fill:#E4C189,stroke:#E99151,stroke-width:2px,stroke-dasharray: 5 5,opacity:0.3 +``` + DBMS 通常提供四大核心功能: 1. **数据定义:** 这是 DBMS 的基础。它提供了一套数据定义语言(Data Definition Language - DDL),让我们能够创建、修改和删除数据库中的各种对象。这不仅仅是定义表的结构(比如字段名、数据类型),还包括定义视图、索引、触发器、存储过程等。 @@ -63,7 +122,7 @@ DBMS 通常提供四大核心功能: ### NewSQL 数据库 -由于 NoSQL 不支持事务,很多对于数据安全要去非常高的系统(比如财务系统、订单系统、交易系统)就不太适合使用了。不过,这类系统往往有存储大量数据的需求。 +由于 NoSQL 不支持事务,很多对于数据安全要求非常高的系统(比如财务系统、订单系统、交易系统)就不太适合使用了。不过,这类系统往往有存储大量数据的需求。 这些系统往往只能通过购买性能更强大的计算机,或者通过数据库中间件来提高存储能力。不过,前者的金钱成本太高,后者的开发成本太高。 @@ -86,13 +145,60 @@ NewSQL 数据库代表:Google 的 F1/Spanner、阿里的 [OceanBase](https://o ## 什么是元组, 码, 候选码, 主码, 外码, 主属性, 非主属性? -- **元组**:元组(tuple)是关系数据库中的基本概念,关系是一张表,表中的每行(即数据库中的每条记录)就是一个元组,每列就是一个属性。 在二维表里,元组也称为行。 -- **码**:码就是能唯一标识实体的属性,对应表中的列。 -- **候选码**:若关系中的某一属性或属性组的值能唯一的标识一个元组,而其任何、子集都不能再标识,则称该属性组为候选码。例如:在学生实体中,“学号”是能唯一的区分学生实体的,同时又假设“姓名”、“班级”的属性组合足以区分学生实体,那么{学号}和{姓名,班级}都是候选码。 -- **主码** : 主码也叫主键。主码是从候选码中选出来的。 一个实体集中只能有一个主码,但可以有多个候选码。 -- **外码** : 外码也叫外键。如果一个关系中的一个属性是另外一个关系中的主码则这个属性为外码。 -- **主属性**:候选码中出现过的属性称为主属性。比如关系 工人(工号,身份证号,姓名,性别,部门). 显然工号和身份证号都能够唯一标示这个关系,所以都是候选码。工号、身份证号这两个属性就是主属性。如果主码是一个属性组,那么属性组中的属性都是主属性。 -- **非主属性:** 不包含在任何一个候选码中的属性称为非主属性。比如在关系——学生(学号,姓名,年龄,性别,班级)中,主码是“学号”,那么其他的“姓名”、“年龄”、“性别”、“班级”就都可以称为非主属性。 +在关系型数据库理论中,理解元组、码、候选码、主码、外码、主属性和非主属性这些核心概念,对于数据库设计和规范化至关重要。这些概念构成了关系数据库的理论基础。 + +```mermaid +graph TD + A[关系数据库概念] --> B[数据组织] + A --> C[码的类型] + A --> D[属性分类] + + B --> B1[元组

表中的行记录] + B --> B2[属性

表中的列] + + C --> C1[码

唯一标识] + C1 --> C2[候选码

最小唯一标识集] + C2 --> C3[主码

选定的候选码] + C1 --> C4[外码

引用其他表主码] + + D --> D1[主属性

候选码中的属性] + D --> D2[非主属性

不在候选码中的属性] + + C3 -.关联.-> C4 + C2 -.构成.-> D1 + + style A fill:#4CA497,stroke:#00838F,stroke-width:3px,color:#fff + style B fill:#00838F,stroke:#005D7B,stroke-width:2px,color:#fff + style C fill:#E99151,stroke:#005D7B,stroke-width:2px,color:#fff + style D fill:#005D7B,stroke:#00838F,stroke-width:2px,color:#fff + + style B1 fill:#E4C189,stroke:#00838F,stroke-width:1px + style B2 fill:#E4C189,stroke:#00838F,stroke-width:1px + + style C1 fill:#E4C189,stroke:#E99151,stroke-width:1px + style C2 fill:#E4C189,stroke:#E99151,stroke-width:1px + style C3 fill:#C44545,stroke:#005D7B,stroke-width:2px,color:#fff + style C4 fill:#E4C189,stroke:#E99151,stroke-width:1px + + style D1 fill:#E4C189,stroke:#005D7B,stroke-width:1px + style D2 fill:#E4C189,stroke:#005D7B,stroke-width:1px +``` + +### 基础概念 + +- **元组(Tuple):** 元组是关系数据库中的基本单位,在二维表中对应一行记录。每个元组包含了一个实体的完整信息。例如,在学生表中,每个学生的完整信息(学号、姓名、年龄等)构成一个元组。 +- **码(Key):** 码是能够唯一标识关系中元组的一个或多个属性的集合。码的主要作用是保证数据的唯一性和完整性。 + +### 码的分类 + +- **候选码(Candidate Key):** 候选码是能够唯一标识元组的最小属性集合,其任何真子集都不能唯一标识元组。一个关系可能有多个候选码。例如,在学生表中,如果"学号"能唯一标识学生,同时"身份证号"也能唯一标识学生,那么{学号}和{身份证号}都是候选码。 +- **主码/主键(Primary Key):** 主码是从候选码中选择的一个,用于唯一标识关系中的元组。每个关系只能有一个主码,但可以有多个候选码。选择主码时通常考虑:简单性、稳定性、无业务含义等因素。 +- **外码/外键(Foreign Key):** 外码是一个关系中的属性或属性组,它对应另一个关系的主码。外码用于建立和维护两个关系之间的联系,是实现参照完整性的重要机制。例如,在选课表中的"学号"如果引用学生表的主码"学号",则选课表中的"学号"就是外码。 + +### 属性分类 + +- **主属性(Prime Attribute):** 主属性是包含在任何一个候选码中的属性。如果一个关系有多个候选码,那么这些候选码中出现的所有属性都是主属性。例如,工人关系(工号,身份证号,姓名,性别,部门)中,如果{工号}和{身份证号}都是候选码,那么"工号"和"身份证号"都是主属性。 +- **非主属性(Non-prime Attribute):** 非主属性是不包含在任何候选码中的属性。这些属性完全依赖于候选码来确定其值。在上述工人关系中,"姓名"、"性别"、"部门"都是非主属性。 ## 什么是 ER 图? @@ -108,7 +214,37 @@ ER 图由下面 3 个要素组成: 下图是一个学生选课的 ER 图,每个学生可以选若干门课程,同一门课程也可以被若干人选择,所以它们之间的关系是多对多(M: N)。另外,还有其他两种实体之间的关系是:1 对 1(1:1)、1 对多(1: N)。 - +```mermaid +erDiagram + STUDENT { + string student_id PK "学号" + string name "姓名" + string gender "性别" + date birth_date "出生日期" + string department "学院名称" + } + + COURSE { + string course_id PK "课程编号" + string course_name "课程名称" + string location "课程地点" + string instructor "开课教师" + float credits "成绩" + } + + ENROLLMENT { + string student_id FK "学号" + string course_id FK "课程编号" + float grade "成绩" + } + + STUDENT ||--o{ ENROLLMENT : "选课" + COURSE ||--o{ ENROLLMENT : "被选" + + style STUDENT fill:#4CA497,stroke:#00838F,stroke-width:2px + style COURSE fill:#005D7B,stroke:#00838F,stroke-width:2px + style ENROLLMENT fill:#E99151,stroke:#C44545,stroke-width:2px +``` ## 数据库范式了解吗? @@ -144,7 +280,7 @@ ER 图由下面 3 个要素组成: 从定义和属性上看,它们的区别是: - **主键 (Primary Key):** 它的核心作用是唯一标识表中的每一行数据。因此,主键列的值必须是唯一的 (Unique) 且不能为空 (Not Null)。一张表只能有一个主键。主键保证了实体完整性。 -- **外键 (Foreign Key):** 它的核心作用是建立并强制两张表之间的关联关系。一张表中的外键列,其值必须对应另一张表中某行的主键值(或者是一个 NULL 值)。因此,外键的值可以重复,也可以为空。一张表可以有多个外键,分别关联到不同的表。外键保证了引用完整性。 +- **外键 (Foreign Key):** 它的核心作用是建立并强制两张表之间的关联关系。一张表中的外键列,其值必须对应另一张表中某行的候选键值(通常是主键,也可以是唯一键),或者是一个 NULL 值。因此,外键的值可以重复,也可以为空。一张表可以有多个外键,分别关联到不同的表。外键保证了引用完整性。 用一个简单的电商例子来说明:假设我们有两张表:`users` (用户表) 和 `orders` (订单表)。 @@ -181,53 +317,239 @@ ER 图由下面 3 个要素组成: ## 什么是存储过程? -我们可以把存储过程看成是一些 SQL 语句的集合,中间加了点逻辑控制语句。存储过程在业务比较复杂的时候是非常实用的,比如很多时候我们完成一个操作可能需要写一大串 SQL 语句,这时候我们就可以写有一个存储过程,这样也方便了我们下一次的调用。存储过程一旦调试完成通过后就能稳定运行,另外,使用存储过程比单纯 SQL 语句执行要快,因为存储过程是预编译过的。 +```mermaid +graph LR + A[存储过程] --> B[定义特征] + A --> C[优势] + A --> D[劣势] + A --> E[应用现状] -存储过程在互联网公司应用不多,因为存储过程难以调试和扩展,而且没有移植性,还会消耗数据库资源。 + B --> B1[SQL语句集合] + B --> B2[包含逻辑控制] + B --> B3[预编译机制] -阿里巴巴 Java 开发手册里要求禁止使用存储过程。 + C --> C1[执行速度快] + C --> C2[运行稳定] + C --> C3[简化复杂操作] + + D --> D1[调试困难] + D --> D2[扩展性差] + D --> D3[无移植性] + D --> D4[占用数据库资源] + + E --> E1[传统企业

使用较多] + E --> E2[互联网公司

很少使用] + E --> E3[阿里规范

明确禁用] + + style A fill:#4CA497,stroke:#00838F,stroke-width:3px,color:#fff + style B fill:#00838F,stroke:#005D7B,stroke-width:2px,color:#fff + style C fill:#E99151,stroke:#C44545,stroke-width:2px,color:#fff + style D fill:#C44545,stroke:#005D7B,stroke-width:2px,color:#fff + style E fill:#005D7B,stroke:#00838F,stroke-width:2px,color:#fff + + style B1 fill:#E4C189,stroke:#00838F,stroke-width:1px + style B2 fill:#E4C189,stroke:#00838F,stroke-width:1px + style B3 fill:#E4C189,stroke:#00838F,stroke-width:1px + + style C1 fill:#E4C189,stroke:#E99151,stroke-width:1px + style C2 fill:#E4C189,stroke:#E99151,stroke-width:1px + style C3 fill:#E4C189,stroke:#E99151,stroke-width:1px + + style D1 fill:#E4C189,stroke:#C44545,stroke-width:1px + style D2 fill:#E4C189,stroke:#C44545,stroke-width:1px + style D3 fill:#E4C189,stroke:#C44545,stroke-width:1px + style D4 fill:#E4C189,stroke:#C44545,stroke-width:1px + + style E1 fill:#E4C189,stroke:#005D7B,stroke-width:1px + style E2 fill:#E4C189,stroke:#005D7B,stroke-width:1px + style E3 fill:#E4C189,stroke:#005D7B,stroke-width:1px +``` + +存储过程是数据库中预编译的SQL语句集合,它将多条SQL语句和程序逻辑控制语句(如IF-ELSE、WHILE循环等)封装在一起,形成一个可重复调用的数据库对象。 + +**存储过程的优势:** + +在传统企业级应用中,存储过程具有一定的实用价值。当业务逻辑复杂时,需要执行大量SQL语句才能完成一个业务操作,此时可以将这些语句封装成存储过程,简化调用过程。由于存储过程在创建时就已经编译并存储在数据库中,执行时无需重新编译,因此相比动态SQL语句具有更好的执行性能。同时,一旦存储过程调试完成,其运行相对稳定可靠。 + +**存储过程的局限性:** + +然而,在现代互联网架构中,存储过程的使用越来越少。主要原因包括:调试困难,缺乏成熟的调试工具;扩展性差,修改业务逻辑需要直接修改数据库对象;移植性差,不同数据库系统的存储过程语法差异较大;占用数据库资源,增加数据库服务器负担;版本管理困难,不便于进行代码版本控制。 + +**行业规范:** + +基于以上原因,许多互联网公司的开发规范中明确限制或禁止使用存储过程。例如,《阿里巴巴Java开发手册》中明确规定禁止使用存储过程,推荐将业务逻辑放在应用层实现,保持数据库的简单和高效。  -## drop、delete 与 truncate 区别? +## DROP、DELETE、TRUNCATE 有什么区别? -### 用法不同 +在数据库操作中,`DROP`、`DELETE` 和 `TRUNCATE` 是三个常用的数据删除命令,它们在功能、性能和使用场景上存在显著差异。 -- `drop`(丢弃数据): `drop table 表名` ,直接将表都删除掉,在删除表的时候使用。 -- `truncate` (清空数据) : `truncate table 表名` ,只删除表中的数据,再插入数据的时候自增长 id 又从 1 开始,在清空表中数据的时候使用。 -- `delete`(删除数据) : `delete from 表名 where 列名=值`,删除某一行的数据,如果不加 `where` 子句和`truncate table 表名`作用类似。 +**DROP命令:** -`truncate` 和不带 `where`子句的 `delete`、以及 `drop` 都会删除表内的数据,但是 **`truncate` 和 `delete` 只删除数据不删除表的结构(定义),执行 `drop` 语句,此表的结构也会删除,也就是执行`drop` 之后对应的表不复存在。** +- 语法:`DROP TABLE 表名` +- 作用:完全删除整个表,包括表结构、数据、索引、触发器、约束等所有相关对象 +- 使用场景:当表不再需要时使用 -### 属于不同的数据库语言 +**TRUNCATE命令:** -`truncate` 和 `drop` 属于 DDL(数据定义语言)语句,操作立即生效,原数据不放到 rollback segment 中,不能回滚,操作不触发 trigger。而 `delete` 语句是 DML (数据库操作语言)语句,这个操作会放到 rollback segment 中,事务提交之后才生效。 +- 语法:`TRUNCATE TABLE 表名` +- 作用:清空表中所有数据,但保留表结构 +- 特点:自增长字段(AUTO_INCREMENT)会重置为初始值(通常为1) +- 使用场景:需要快速清空表数据但保留表结构时使用 -**DML 语句和 DDL 语句区别:** +**DELETE命令:** -- DML 是数据库操作语言(Data Manipulation Language)的缩写,是指对数据库中表记录的操作,主要包括表记录的插入、更新、删除和查询,是开发人员日常使用最频繁的操作。 -- DDL (Data Definition Language)是数据定义语言的缩写,简单来说,就是对数据库内部的对象进行创建、删除、修改的操作语言。它和 DML 语言的最大区别是 DML 只是对表内部数据的操作,而不涉及到表的定义、结构的修改,更不会涉及到其他对象。DDL 语句更多的被数据库管理员(DBA)所使用,一般的开发人员很少使用。 +- 语法:`DELETE FROM 表名 WHERE 条件` +- 作用:删除满足条件的数据行,不带WHERE子句时删除所有数据 +- 特点:自增长字段不会重置,继续从之前的值递增 +- 使用场景:需要有选择地删除部分数据时使用 + +`TRUNCATE` 和不带 `WHERE`子句的 `DELETE`、以及 `DROP` 都会删除表内的数据,但是 **`TRUNCATE` 和 `DELETE` 只删除数据不删除表的结构(定义),执行 `DROP` 语句,此表的结构也会删除,也就是执行`DROP` 之后对应的表不复存在。** + +### 对表结构的影响 + +- `DROP`:删除表结构和所有数据,表将不复存在 +- `TRUNCATE`:仅删除数据,保留表结构和定义 +- `DELETE`:仅删除数据,保留表结构和定义 + +### 触发器 + +- `DELETE` 操作会触发相关的DELETE触发器 +- `TRUNCATE` 和 `DROP` 不会触发DELETE触发器 -另外,由于`select`不会对表进行破坏,所以有的地方也会把`select`单独区分开叫做数据库查询语言 DQL(Data Query Language)。 +### 事务和回滚 -### 执行速度不同 +- `DROP` 和 `TRUNCATE` 属于DDL操作,执行后立即生效,不能回滚 +- `DELETE` 属于DML操作,可以回滚(在事务中) -一般来说:`drop` > `truncate` > `delete`(这个我没有实际测试过)。 +### 执行速度 -- `delete`命令执行的时候会产生数据库的`binlog`日志,而日志记录是需要消耗时间的,但是也有个好处方便数据回滚恢复。 -- `truncate`命令执行的时候不会产生数据库日志,因此比`delete`要快。除此之外,还会把表的自增值重置和索引恢复到初始大小等。 -- `drop`命令会把表占用的空间全部释放掉。 +一般来说:`DROP` > `TRUNCATE` > `DELETE`(这个我没有实际测试过)。 + +- `DELETE`命令执行的时候会产生数据库的`binlog`日志,而日志记录是需要消耗时间的,但是也有个好处方便数据回滚恢复。 +- `TRUNCATE`命令执行的时候不会产生数据库日志,因此比`DELETE`要快。除此之外,还会把表的自增值重置和索引恢复到初始大小等。 +- `DROP`命令会把表占用的空间全部释放掉。 Tips:你应该更多地关注在使用场景上,而不是执行效率。 +## DML 语句和 DDL 语句区别是? + +- DML 是数据库操作语言(Data Manipulation Language)的缩写,是指对数据库中表记录的操作,主要包括表记录的插入、更新、删除和查询,是开发人员日常使用最频繁的操作。 +- DDL (Data Definition Language)是数据定义语言的缩写,简单来说,就是对数据库内部的对象进行创建、删除、修改的操作语言。它和 DML 语言的最大区别是 DML 只是对表内部数据的操作,而不涉及到表的定义、结构的修改,更不会涉及到其他对象。DDL 语句更多的被数据库管理员(DBA)所使用,一般的开发人员很少使用。 + +另外,由于`SELECT`不会对表进行破坏,所以有的地方也会把`SELECT`单独区分开叫做数据库查询语言 DQL(Data Query Language)。 + ## 数据库设计通常分为哪几步? -1. **需求分析** : 分析用户的需求,包括数据、功能和性能需求。 -2. **概念结构设计** : 主要采用 E-R 模型进行设计,包括画 E-R 图。 -3. **逻辑结构设计** : 通过将 E-R 图转换成表,实现从 E-R 模型到关系模型的转换。 -4. **物理结构设计** : 主要是为所设计的数据库选择合适的存储结构和存取路径。 -5. **数据库实施** : 包括编程、测试和试运行 -6. **数据库的运行和维护** : 系统的运行与数据库的日常维护。 +```mermaid +graph TD + A[数据库设计流程] --> B[1.需求分析] + B --> C[2.概念结构设计] + C --> D[3.逻辑结构设计] + D --> E[4.物理结构设计] + E --> F[5.数据库实施] + F --> G[6.运行和维护] + + B --> B1[数据需求

功能需求

性能需求] + C --> C1[E-R建模

实体关系图] + D --> D1[关系模型

表结构设计

规范化] + E --> E1[存储结构

索引设计

分区策略] + F --> F1[编程开发

测试部署

数据迁移] + G --> G1[性能监控

备份恢复